Colossus Project Flux - v10_AIO_FP8

Verwandte Schlüsselwörter & Tags

Empfohlene Prompts

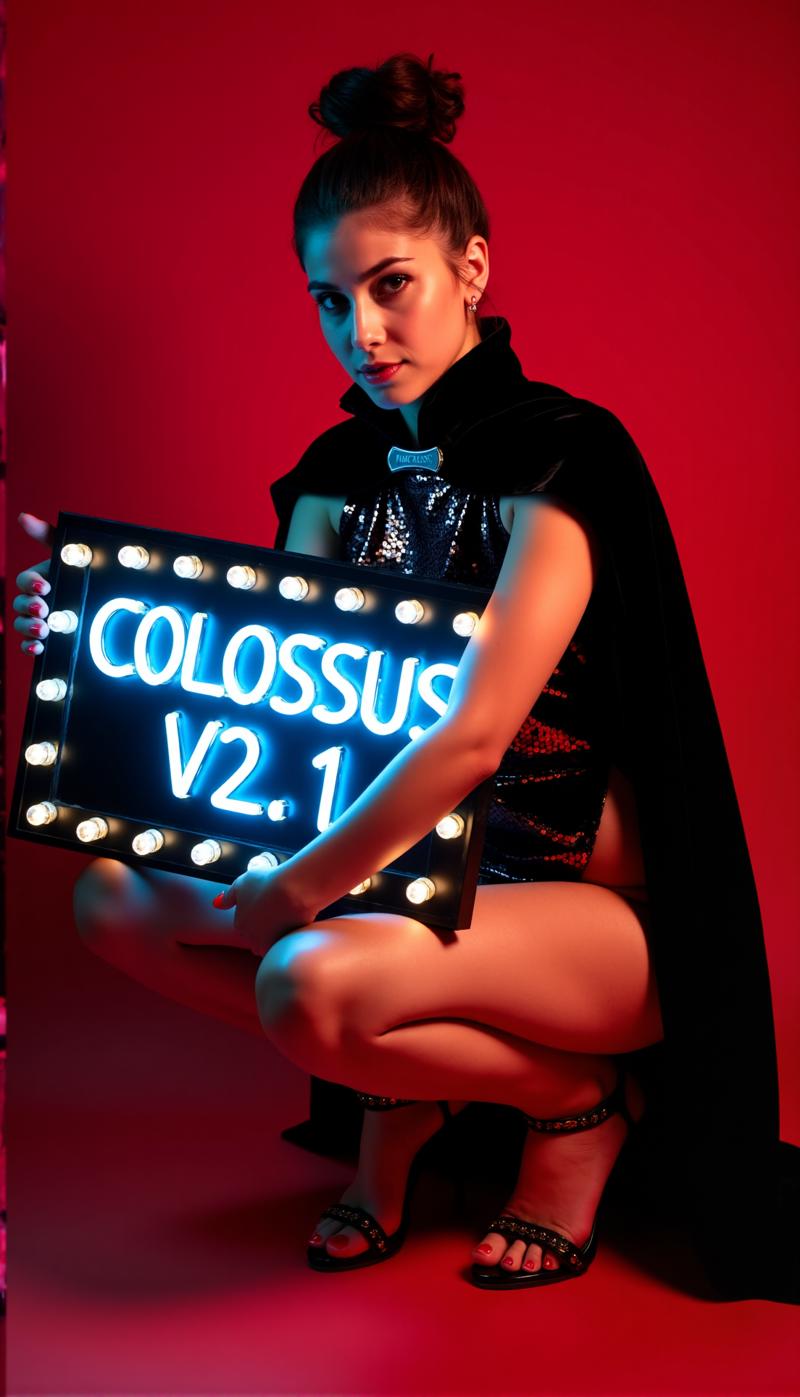

photography of a man wearing a steampunk monocle a swirly fench mustache and a tall top hat, 20-year-old goth woman, he is holding a pocket watch with the manufaturer "COLOSSUS written in black, long white braided hair black ribbon in hair, shot on Panasonic Lumix GH5 with Leica DG 25mm f-1.4, choker necklace, red eyes, slim fit figure, small perk breasts, gothic black leather and lace short lingerie dress, black fishnet thigh high stocking, black lace panties, she is emerging from swirling smoke tendrils, with soft blue ethereal lighting, a very haunting and dark image

Empfohlene Negative Prompts

blurry

blurry, low res

Empfohlene Parameter

samplers

steps

cfg

resolution

vae

Tipps

Verwende negativen Prompt 'blurry' zur Qualitätsverbesserung.

Bei V2.1 die Flux Guidance Skala deaktivieren und stattdessen CFG verwenden.

Empfohlener Sampler und Scheduler: Euler mit Simple Scheduler funktioniert gut; auch Heun, DPM++ 2M, Deis und DDIM funktionieren hervorragend.

V12 'Behemoth' AIO-Version enthält kundenspezifisches T5xxl und Clip_L integriert für hohe Qualität.

Unterschiedliche Quantifizierungsversionen verfügbar: FP4 nur für Nvidia 50xx GPUs; int4 für 40xx und darunter (mindestens 20xx GPU erforderlich).

Siehe bereitgestellte Workflow-Anleitungen für Installation und optimale Nutzung.

Versions-Highlights

V10 "Ouroboros"

Ersteller-Sponsoren

Wenn dir das FLUX-Serie Modell gefällt, kannst du den Ersteller auf Ko-fi unterstützen.

Quantifizierte Versionen und Modelldownloads sind bei Huggingface verfügbar.

Detaillierte Installations- und Workflow-Anleitungen findest du auf Civitai.

Tief unter einem Berg lebt ein schlafender Riese, der entweder der Menschheit helfen oder Zerstörung anrichten kann...

Ein Koloss erhebt sich...

Nach meiner SDXL-Serie ist es Zeit für die FLUX-Serie dieses Projekts... Dieses Mal habe ich das Ganze von Grund auf neu trainiert. Für das Training habe ich meine eigenen Bilder verwendet. Ich habe sie mit meinem schnellen Flux-Modell DemonFlux/Colossus Project schnell + meinem SDXL Colossus Project 12 als Verfeinerer erstellt.

Dieses SD Flux-Checkpoint kann nahezu alles produzieren.. Colossus erzeugt extrem realistische Bilder, Anime und Kunst sehr gut.

Wenn es dir gefällt, gib mir gerne Feedback. Wenn du mich unterstützen möchtest, kannst du das hier tun. Ich habe einiges Geld investiert, um einen Computer zu bauen, der tatsächlich Flux-Modelle trainieren kann.. Auch das Training und Testen benötigt viel Zeit und Strom..

https://ko-fi.com/afroman4peace

Version V12 "Hephaistos"

Es macht mich gleichzeitig glücklich und traurig, diesen Checkpoint zu veröffentlichen.. V12 wird der letzte Checkpoint dieser Serie sein.. Der Hauptgrund sind die kommenden EU-KI-Gesetze... Ein weiterer Grund ist die Lizenz von Flux .1 DEV selbst. Vielen Dank für die Unterstützung! Ich habe im letzten Jahr viel Zeit in dieses Projekt gesteckt. Nun ist es Zeit, zu einem anderen Projekt überzugehen.

Jedenfalls werde ich diese Serie mit einem Höhepunkt beenden...

V12 basiert auf V10B "BOB", enthält aber im Prinzip die besten Teile dieser Serie blockmerged in einem Checkpoint. (Dies war das Ergebnis einer neuen Merge-Methode, die etwa 1:30 Stunden dauerte und meinen gesamten 128GB RAM beanspruchte). Ich habe auch Gesichts- und Hauttexturen im Vergleich zu V10 verbessert. Die Augen sind wesentlich realistischer und lebendiger als zuvor.

Teste es selbst und gib mir Feedback zu V12. Dank meiner langsamen Internetverbindung werde ich zuerst den FP8_UNET hochladen. Danach die FP8 "All in One"-Version sowie FP16_unet und FP16_BEHEMOTH. Ich werde auch versuchen, es in int4 und fp4 zu konvertieren (wünscht mir Glück dabei).

Wie immer freue ich mich über Feedback zu V12..

Version V12 "Behemoth" (AIO)

Dieses "All in One"-Modell ist das Beste meiner V12-Serie.. und natürlich das größte in der Größe :-)

Der Behemoth enthält ein kundenspezifisches T5xxl und Clip_l, die im Modell integriert sind. Wenn du Qualität der Quantität vorziehst, ist dies der Checkpoint für dich!

Version V12 FP4/int4

Dank Muyang Li von Nunchakutech, der die Quantifizierung von V12 durchgeführt hat. https://huggingface.co/nunchaku-tech und ihren erstaunlichen Nunchaku!

Diese Version ist wirklich beeindruckend. Sie kombiniert Qualität und Geschwindigkeit wie nie zuvor.

ACHTUNG!

Es gibt zwei Versionen: FP4 und int4. FP4 ist nur für Nvidia 50xx Grafikkarten! int4 funktioniert mit 40xx und darunter (mindestens eine 20xx Grafikarte erforderlich).

Du kannst beide Versionen auch direkt hier herunterladen: https://huggingface.co/nunchaku-tech/nunchaku-flux.1-dev-colossus

INSTALLATIONSANLEITUNG und WORKFLOW

Hier ist eine schnelle Installationsanleitung und ein WIP-Workflow.

https://civitai.com/articles/17313

DETAILLIERTE ANLEITUNG für den Workflow

https://civitai.com/articles/17358

Ich arbeite noch an meinen neuen Workflows für Nunchaku.. daher ist der folgende Workflow noch sehr WIP (Work in Progress). Ich werde am Wochenende einen detaillierten Artikel hinzufügen.

Version V12 FP16_B_variant

Dank eines kleinen Fehlers, den ich spät nachts (2 Uhr) gemacht habe, habe ich den "falschen" Checkpoint umbenannt und hochgeladen. Es ist ein sehr experimenteller Checkpoint, der nie zur Veröffentlichung gedacht war. Er wurde nicht viel getestet, zeigte aber bei der Showcase-Erstellung sehr gute Leistung. Möglicherweise besser als die Standardversion.

Er tendiert dazu, eher asiatische Gesichter zu bevorzugen.. Das liegt daran, dass ich etwas testen wollte, das ich in ein Nebenprojekt einbringen möchte, an dem ich noch arbeite. Berichte mir deine Erfahrungen mit diesem Checkpoint :-)

Version V12 AIO FP8

Diese Version ist eine All-in-One-Version von V12. Das bedeutet, dass alle Clips darin integriert sind. Sie liefert die gleiche Ausgabe wie der FP8_unet mit meinem benutzerdefinierten clip_l.

Version V12 GGUF Q5_1

Diese Version wurde angefragt. Die Qualität ist nicht schlecht..

Version V10B "BOB"

Dies ist eine alternative Version von V10. Ich habe sie erstellt, um die FP8-Version von V10 zu verbessern. Generell ist die FP8-Version präziser und die Farben besser. Leider hatte ich kürzlich nicht viel Zeit.. (RL geht vor). Deshalb hat das so lange gedauert.. Lass mich wissen, ob du diese Version bevorzugst. Ich habe auch eine FP16-Version von "BOB". Je nach Feedback werde ich auch eine int4-Version veröffentlichen.

WORKFLOW:

Hier ist der Workflow für V12 und V10: https://civitai.com/articles/17163

Version V10_int4_SVDQ "Nunchaku"

Zuerst möchte ich mich bei theunlikely https://huggingface.co/theunlikely bedanken, der den FP16_Unet in int4_SVDQ konvertiert hat. Besuch seine Seite und hinterlasse ein Like.

Diese Version ist mehr oder weniger gleichwertig zur FP8-Version. Selbst im normalen Modus meines Workflows ist diese etwa 2-3 Mal schneller als das reguläre Modell. Mit dem "schnellen Modus" des Workflows kann ich ein 2MP-Bild in etwa 19 Sekunden mit meiner 3090ti rendern.

Was ist SVDQ "Nunchaku"?

Diese neue Quantifizierungsmethode ermöglicht es, Flux-Modelle (in diesem Fall ein natives FP16-Modell) von 24GB auf etwa 6,7GB zu schrumpfen. Aber das ist nicht alles: Du kannst schneller als je zuvor generieren, ohne zu viel Qualität zu verlieren. Natürlich siehst du einen kleinen Unterschied zu meinem 32GB_Behemoth, aber für diesen benötigst du deutlich mehr VRAM/RAM, um es auszuführen.

Für mehr Informationen besuche: https://github.com/mit-han-lab/ComfyUI-nunchaku?tab=readme-ov-file

Installation: Bitte besuche meine Workflow/Installationsanleitung: https://civitai.com/articles/15610

Version V10 "Behemoth" (FP16_AIO)

Diese Version ist noch experimentell. Der Fokus lag darauf, realistischere Ergebnisse zu erzielen. Außerdem konnte ich einige "Flux-Linien" reduzieren. Dieses Modell basiert auf Colossus Project V5.0_Behemoth, V9.0 und einem weiteren Projekt, das ich "Ouroborus Project" nenne.

Die FP16-Version ist sehr stabil. Eine FP8-Version werde ich bald veröffentlichen. Diese Version ist ebenfalls sehr gut, aber nicht so stabil..

Ich lasse dich damit experimentieren.. Sag mir, was du von dieser Version hältst.

Viel Spaß beim Erstellen :-)

Version V9.0:

Nun, ich muss viel erklären.. Warum überhaupt V9.0?

Ich bin vor Kurzem in eine neue Wohnung gezogen und wegen Fehlern des Internetanbieters hatte ich keine richtige Internetverbindung.. Während des Umzugs habe ich meinen Computer laufen lassen. Als Ergebnis entstanden viele (meist defekte) Checkpoints. Ich habe aber auch einige sehr gute V8-Versionen, die ich vielleicht veröffentlichen werde..

Was hat sich geändert?

Ich habe neue Gesichts- und Hauttexturen ins Modell eintrainiert, indem ich im Grunde die besten Ergebnisse von V5.0 genommen habe. Außerdem wurde das Modell auf Füße/Beine für bessere Anatomie trainiert. Die V5.0-Versionen haben manchmal Kopf und Füße abgeschnitten.. Ich denke, ich habe einige dieser Probleme behoben..

Zusätzlich habe ich es mit mehr eigenen Landschaftsbildern trainiert.. und ja, das alles während des Umzugs.. Die Gesamtrechenzeit betrug etwa zwei Wochen, was nicht gerade günstig ist (jede Stunde kostet mich etwa 25 Cent Strom).

Ich hoffe, die Version gefällt dir.. Wenn du mich unterstützen möchtest: Poste ein paar schöne Bilder oder gib mir einen Tipp über Buzz oder Ko-fi..

Sag mir, was du denkst :-)

Version 5.0:

V5.0 basiert tatsächlich auf V4.2 und V4.4 (wird auch bald veröffentlicht). Es enthält zusätzliches Training zu Hautdetails und allgemeiner Anatomie, was größtenteils Probleme wie Hände und Brustwarzen behoben hat. Die Gesichtsdetaillierung ist deutlich besser. Ich habe auch einige kleinere Flux-Linien versucht zu beheben..

Generell ist diese Version realistischer als V4.2 und besser bei kleinen Details.. Wie Version 4.2 ist diese Version ebenfalls ein Hybrid-De-distilled-Modell. Du kannst es im Prinzip mit den gleichen Einstellungen wie V4.2 verwenden.

Hier ist auch ein neuer Workflow zum Ausprobieren: https://civitai.com/articles/11950/workflow-for-colossus-project-flux-50

Sag mir, was du von dieser Version im Vergleich zu 4.2 oder V2.1 hältst..

Version 4.4 "Research":

Ich habe diese Version nur zur Vollständigkeit hinzugefügt.. Sie ist etwas realistischer als V4.2 und die Grundlage von Version 5.0. Du kannst sie ausprobieren, wenn du möchtest. Du kannst auch den Workflow für V5.0 und V4.2 verwenden..

Version 4.2:

Diese Version ist im Grunde eine Weiterentwicklung von Demoncore Flux und Colossus Project Flux. Das Ziel war ein stabileres Ergebnis mit besseren Hauttexturen, besseren Händen und mehr Vielfalt bei Gesichtern. Ich habe es auf einem Hybridmodell trainiert, das teilweise Demoncore Flux enthält. Ich habe die Brustwarzen und NSFW ein wenig verbessert. Sag mir, ob du V4.2 der Version 2.1 vorziehst :-)

Für die Showcase-Bilder habe ich nur native Bilder in SDXL-Auflösung oder 2MP-Auflösung (z. B. 1216x1632) verwendet. Dieses Modell kann sogar höhere Auflösungen verarbeiten.. Ich habe diesen Checkpoint bis zu 2500x2500 getestet, empfehle aber eher ca. 2000x2000.

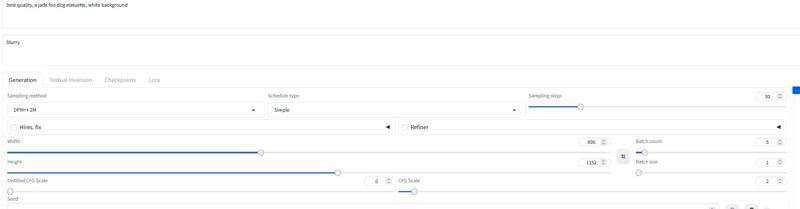

Für die Einstellungen empfehle ich etwa 30 Schritte und 2-2,5 CFG. Ich verwende meistens 2,2 oder 2,3 in meinem Workflow. Für die Showcases habe ich DPM++ 2M mit einfachem Scheduler verwendet.

Ich werde bald weitere Versionen hinzufügen, habe aber bis Weihnachten nicht viel Zeit..

Einstellungen

Ich werde bald einen neuen, dedizierten Comfy-Workflow hinzufügen. Du kannst vorerst jederzeit die Showcase-Bilder herunterladen und öffnen..

Die "All in One"-Version funktioniert auch gut mit Forge..

Grundsätzlich funktioniert sie mit denselben Einstellungen wie Version 2.1 (siehe unten)

Nimm 20-30 Schritte mit etwa 2,2 CFG..

Version 2.1_de-distilled_experimental (MERGE)

Diese Version ist komplett anders und funktioniert eigentlich anders als ein normales Flux-Modell!

Es ist ein experimenteller Merge meiner Version 2.0 und einer de-distilled Version https://huggingface.co/nyanko7/flux-dev-de-distill. Das passierte eher zufällig, aber die Ergebnisse sind beeindruckend. Du bekommst atemberaubende Details und das Modell folgt den Prompts extrem gut... Als nächstes will ich direkt auf dem de-distilled Modell trainieren. Ich habe bereits einige Test-Loras damit erstellt. Es ist sehr experimentell, also sag bitte Bescheid, falls du Fehler findest, die unten nicht aufgeführt sind. Wenn du gute Bilder hast, poste sie.. auch schlechte, das kann helfen, Dinge zu verbessern :-). Vielleicht probiere auch Version 2.0 aus und sag mir, welche Checkpoint-Version dir am besten passt.

Achtung!

Der normale Flux-Workflow funktioniert nicht mit dieser Version. DU MUSST meinen Workflow herunterladen!

Du kannst auch selbst etwas herausfinden, aber bitte beschwere dich nicht über schlechte Bilder. Es ist ein sehr experimentelles Modell... siehe Nachteile unten..

Vor- und Nachteile dieses Checkpoints:

Dieses Modell kann extrem detaillierte Bilder erzeugen, das hat aber seinen Preis.. Es ist langsamer als normale Flux-Checkpoints. Der Vorteil ist, dass du oft keinen zusätzlichen Upscale mehr brauchst. Statt Flux Guidance verwendet dieses Modell die CFG-Skala. Das heißt auch, es funktioniert nicht mit Standard-Workflows.

Negative Prompts sind nutzbar! Das hilft, unerwünschte Dinge aus dem Bild zu entfernen.

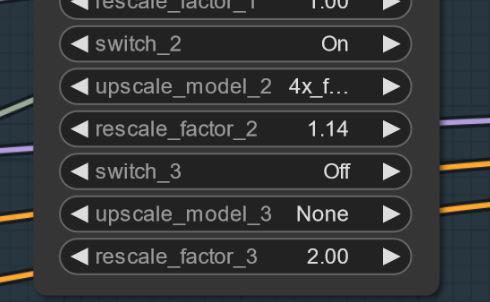

Manchmal tauchen Artefakte auf.. Du kannst das mit einem einfachen Upscale beheben (ich arbeite daran). Hier ein Beispiel.. es passiert nicht bei jedem Seed.. UPDATE: Das ist kein Problem des Modells, sondern eher des Workflows.. Ich arbeite an einer Lösung. Falls es passiert, probiere den ersten Upscale-Wert auf 1,14 statt 1,2 zu setzen.

Einstellungen und Workflow V2.1:

Hier findest du den Workflow: https://civitai.com/articles/8419

Einstellungen: Anders als bei normalem Flux wird hier keine Flux Guidance Skala benötigt. Nutze stattdessen CFG. Ich verwende meist 3 CFG für den Workflow.. Manche Bilder brauchen auch niedrigere CFG-Werte.

Das Wichtigste ist, die Flux Guidance Skala auszuschalten..

Ohne Workflow habe ich es mit 30 Schritten und 2-3 CFG getestet. Das könnte auch für Forge die Einstellungen sein. Experimentiere gerne.

Ich empfehle, das Wort "blurry" in die negativen Prompts aufzunehmen.

Sampler und Scheduler:

Es stehen verschiedene funktionierende Sampler zur Auswahl:

Euler, Heun, DPM++ 2M, Deis, DDIM funktionieren gut.

Als Scheduler nutze ich meist "Simple".

Wenn du bessere Einstellungen findest, sag Bescheid.. :-)

Für Forge empfehle ich das AIO-Modell.. Hier ein Beispiel für die Einstellungen:

Version 2.0_dev_experimental

Nun.. das ist eine experimentelle Version.. Das Ziel war, ein kohärenteres und schnelleres Modell zu erstellen. Ich habe einige zusätzliche selbst trainierte Loras integriert und die resultierenden Modelle auf spezielle Weise (Tensor Merge) zusammengeführt. Es enthält ein kundenspezifisches T5xxl, das ich mit "Attention Seeker" modifiziert habe. Für Geschwindigkeit und zusätzliche Qualität habe ich den Hyper Flux Lora von ByteDance integriert. Das bedeutet, dass sich der Arbeitsbereich verschoben hat.. Hier ist das Haupttitelbild..

16 Schritte V 2.0

30 Schritte V 1.0

30 Schritte V 1.0

Nachteile:

Nachteile:

Erstens ist diese Version etwas größer als die letzte.. zweitens muss ich noch eine reine Unet-Version erstellen. Ich werde das aktualisieren, wenn es fertig ist..

Einstellungen und Workflow V2.0:

Du kannst das Modell jetzt mit weniger Schritten laufen lassen.. 16 Schritte entsprechen 30 Schritten des alten Modells.

Ich empfehle trotzdem etwa 20-30 Schritte, da das in den meisten Fällen bessere Qualität liefert.

Sampler: Ich bevorzuge Euler mit Simple als Scheduler. Die Guidance kannst du von 1,5-3 einstellen (gerne auch außerhalb dieses Bereichs testen). Eine Guidance von 1,8 funktioniert gut für realistische Bilder. Du kannst auch andere Sampler testen. DPM++ 2M und Heun funktionieren ebenfalls gut.

Workflow 2.0:

Ich habe einen neuen Workflow für V2.0 und V1.0 erstellt. Er enthält den neuen Flux Prompt Generator. Außerdem habe ich die zweite Upscaler-Stufe implementiert. https://civitai.com/articles/7946

Forge:

Ich habe dieses Modell auch mit Forge getestet, und es funktionierte sehr gut.. Die Bilder können aber zwischen Comfy UI und Forge variieren..

Version 1.0_dev_beta:

Dieses Modell ist mein erster Eintrag der Serie. Bitte gib mir Feedback und poste Bilder. Das hilft mir, das Projekt weiter zu verbessern. Es gibt mehrere Versionen zur Auswahl. Das qualitativ beste Modell ist die FP16-Version. Diese ist allerdings riesig und benötigt eine potente Grafikkarte und viel RAM. Die FP8-Version ist die Lösung mit gutem Kompromiss zwischen Qualität und Leistung. Wenn du eine GGUF-Version möchtest, lade die Q8_0 herunter. Die GGUF Q4_0/4.1 Version wurde angefragt. Sie ist klein, aber mit Qualitätsverlust.

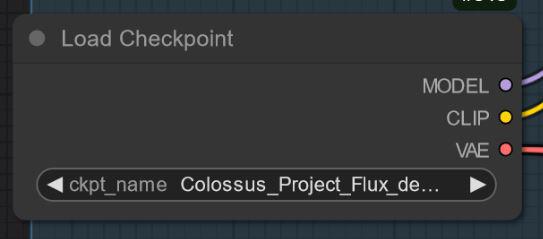

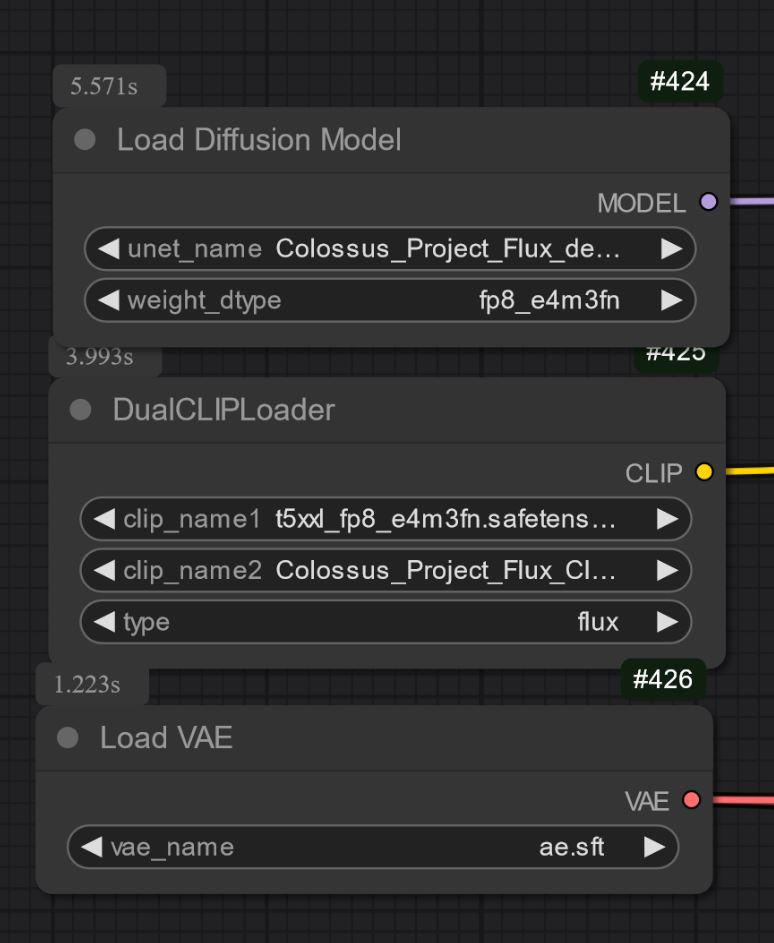

Grundsätzlich gibt es zwei Arten meiner Modelle: "All in one"-Modelle, die nur eine Datei benötigen. Diese enthalten Clip_l, T5xxl fp8 und den VAE baked in (siehe unten). Einfach in deinen Checkpoints-Ordner legen.

Die anderen Versionen sind nur UNET. Hier musst du alle Dateien separat laden.

Du musst in jedem Fall meinen Clip_L herunterladen, damit sie richtig funktionieren..

Wichtig ist auch, den richtigen T5xxl Clip zu wählen. Für FP8 ist das der fp8_e4m3fn T5xxl Clip. Für FP16 ist es der FP16 Clip. Achte auf die Standard-Gewichtsart. (Unten ist ein Beispielbild für die FP8-Version)

Für GGUF-Version brauchst du den GGUF Loader!

Einige bekannte Punkte für V1.0:

Dies ist das erste Modell der Serie, daher könnte es bei einigen Prompts oder Stilen (z.B. Kunst) Schwierigkeiten geben. Die nächste Version erhält mehr Training. Sag mir, was das Modell nicht kann..

Einstellungen und Workflow:

Ich habe es mit etwa 30 Schritten getestet, Euler mit Simple Scheduler. Guidance kann von 1,5-3 eingestellt werden (probiere auch außerhalb dieses Bereichs).

Eine Guidance von 1,8 funktioniert gut für realistische Bilder.

Probier diese Einstellungen aus.. Wenn du gute Ergebnisse erzielst, poste sie bitte.

Ich habe die Showcase-Bilder als Trainingsdaten hinzugefügt.. Darin ist auch der Workflow für Comfy enthalten. Hier der Download-Link für den Workflow: https://civitai.com/articles/7946

"All in one" Modell:

UNET-only:

Du musst auch den Clip_L herunterladen, die Datei ist 240MB groß.

Du musst auch den Clip_L herunterladen, die Datei ist 240MB groß.

GGUF: Hier ist der Workflow für GGUF: https://civitai.com/articles/7946

Wichtig:

Das Dev-Modell ist nicht für kommerzielle Nutzung gedacht. Dafür werde ich das "schnell"-Modell an anderer Stelle veröffentlichen. Es ist eher für den persönlichen oder wissenschaftlichen Gebrauch gedacht.

LIZENZ:

https://huggingface.co/black-forest-labs/FLUX.1-dev/blob/main/LICENSE.md

Credits:

theunlikely https://huggingface.co/theunlikel (nochmals Danke)

Version 2.1/V4.2/5.0: Flux_dev_de-distill von nyanko7

https://huggingface.co/nyanko7/flux-dev-de-distill

Ab V2.0: Hyper Lora von ByteDance https://huggingface.co/ByteDance/Hyper-SD

Black Forrest für ihr erstaunliches Flux-Modell https://huggingface.co/black-forest-labs

Modell-Details

Modelltyp

Basismodell

Modellversion

Modell-Hash

Ersteller

Diskussion

Bitte log in um einen Kommentar zu hinterlassen.

Modellsammlung - Colossus Project Flux

Colossus Project Flux - v12_int4_SVDQ_nunchaku

Colossus Project Flux - V12 "Hephaistos" FP8_UNET

Colossus Project Flux - v10_AIO_FP8