EnvyBetterHands LoCon - beta2

Verwandte Schlüsselwörter & Tags

Empfohlene Prompts

nice hands,perfect hands,beautiful hands,fingernails

(masterpiece,best quality:1.3),nice hands

Empfohlene Negative Prompts

extra fingers,deformed hands,polydactyl:1.5,worst quality, low quality, poor quality, bad quality:1.35

deformed hands,polydactyl:1.3),(worst quality,low quality,poor quality,bad quality:1.35)

Empfohlene Parameter

samplers

steps

cfg

resolution

vae

other models

Empfohlene Hires (Hochauflösungs-) Parameter

upscaler

upscale

steps

denoising strength

Tipps

Die Stärke sollte auf etwa 1,0 eingestellt sein.

Frei mit anderen LoRAs mischen für bessere Ergebnisse.

Vermeide die Nutzung negativer Einbettungen wie badhandv4 zur Verbesserung der Hände.

Experimentiere mit dynamischem Thresholding für bessere Resultate.

Versions-Highlights

Training komplett neu gestartet, da offenbar Training auf vanilla 1.5 besser ist, um Modelle zu erstellen, die nicht übersteuern oder den Stil stark verändern. Diese neue Version braucht noch mehr Training, ist daher nicht so effektiv wie die alte, scheint aber im Durchschnitt etwas zu verbessern, funktioniert mit viel mehr Modellen und verändert den Stil überhaupt nicht, daher glaube ich, dass dies der richtige Weg ist. Ich werde mit Prompts experimentieren und die Hauptbeschreibung entsprechend aktualisieren.

Ersteller-Sponsoren

Ich benutze Lora Block Weight. Ich glaube, du kannst auch Additional Networks und SD Webui Lycoris verwenden.

Dieses Modell ist ein LoCon. Du MUSST die Lycoris-Erweiterung installieren, damit es geladen wird.

Ich benutze Lora Block Weight. Ich glaube, du kannst auch Additional Networks und SD Webui Lycoris verwenden.

UPDATE 27.04.2023: Ich habe eine Trainingsplateau erreicht, daher füge ich gerade viele weitere Bilder zum Datensatz hinzu, darunter auch kompliziertere Sachen wie verschränkte Finger. Wahrscheinlich werde ich die Lernrate noch weiter senken müssen, daher könnte es jetzt langsamer werden. Ich halte alle auf dem Laufenden, wie es vorangeht.

Update: Prompting-Tipps für beta 2:

Dies ist ein komplett neues Training auf vanilla Stable Diffusion 1.5. Ich habe es auf Rat eines anderen Enthusiasten gemacht, und es ist erstaunlich, wie viel kompatibler es mit verschiedenen Modellen ist. Es beeinflusst den Stil deines Modells meiner Ansicht nach überhaupt nicht, sondern betrifft hauptsächlich Hände und gelegentlich Arme, der Rest bleibt unverändert.

Es scheint am besten bei einer Stärke von 1 zu funktionieren, obwohl höhere Werte (1,5, 2 usw.) bei manchen Bildern helfen können, auf Kosten schlechterer Ergebnisse bei anderen. Es ist nicht nötig, deinen CFG-Wert zu verändern, da es bei diesen Stärken nicht zu Übersteuerungen kommt.

Mische es frei mit anderen LoRAs.

Am besten waren meine Ergebnisse, wenn ich im positiven Prompt "nice hands, perfect hands" schrieb (eine Erhöhung des Gewichtes verschlechtert die Ergebnisse) und im negativen Prompt "(extra fingers, deformed hands, polydactyl:1.5)“. Das ist für EnvyMix v1 (und vermutlich auch RevAnimated) gültig, bei anderen Modellen kann es variieren.

Negative Einbettungen für "bad hands" scheinen die Ergebnisse eher zu verschlechtern, allerdings habe ich das nicht ausführlich getestet.

Wie üblich zaubert das Modell keine Wunder, aber über viele Bilder gesehen verbessert es im Durchschnitt deutlich die Ergebnisse. Hoffentlich verbessert sich das mit ein paar weiteren Nächten Training noch weiter.

Prompting-Tipps für alpha 3 und beta 1:

Beachte, dass diese Tipps für RevAnimated 1.2 gelten. Bei anderen Modellen kann es anders sein.

Das Modell neigt dazu, etwas zu überbelichten, aber mit Stärke 1 funktioniert es gut. Du kannst das kompensieren, indem du den CFG-Wert auf 5 oder 6 senkst. Ich hatte Erfolg mit der dynamischen Schwellenwert-Erweiterung, die ich auf mimic CFG 5 eingestellt habe, so kann ich dann CFG 9 oder 10 nutzen ohne schlechte Ergebnisse.

Ich habe es mit einem anderen LoRA probiert und seltsame Ergebnisse bekommen, daher variiert es auch hier. Im Moment versuche ich, eine einfache konsistente Nutzung zu erreichen.

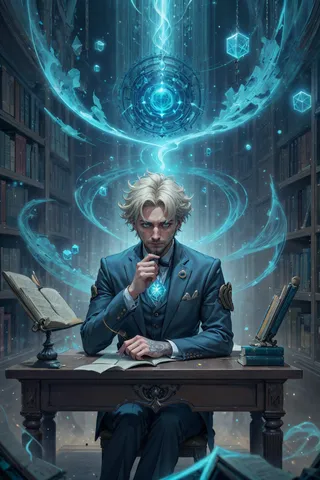

Merkwürdigerweise scheint die Leistung bei neutralen Handpositionen zurückgegangen zu sein, aber bei komplexeren Interaktionen, wie dem Halten von Objekten (deswegen habe ich viele Bilder von Schmieden und Bibliothekaren als Beispiele), ist es deutlich besser.

Halte deine Prompts einfach, dann liefert es tendenziell bessere Ergebnisse.

Mit RevAnimated erhalte ich ungefähr 1 bis 2 brauchbare Bilder von 8, der Rest ist nah dran und lässt sich vermutlich durch Inpainting reparieren.

Prompting-Tipps für alpha 2:

Es wird stärker und funktioniert am besten bei Stärke 1. Ein Wert von 1,3 wie in der vorherigen Version lässt die Ergebnisse schlecht aussehen.

Mein negativer Prompt ist weiterhin „(extra fingers, deformed hands:1.15), (worst quality, low quality, poor quality, bad quality:1.35)“

Ich hatte guten Erfolg, wenn ich einfach „nice hands“ im Hauptprompt verwendet habe.

Prompting-Tipps für alpha 1:

Dein Prompt sollte die Worte „beautiful hands, perfect hands, fingernails“ enthalten. Ich hatte am meisten Erfolg, wenn sie in der Mitte standen und nicht betont wurden.

Der alpha1 LoCon scheint bei Stärke um 1,3 am besten zu funktionieren (getestet mit RevAnimated 1.1 – bei anderen Modellen kann es variieren)

Verwende keine negativen Einbettungen zur Verbesserung von Händen. Nachdem ich badhandv4 aus meinem negativen Prompt entfernt habe, wurden die Ergebnisse deutlich besser. Du kannst es auch ohne negative Einbettungen versuchen. Ich habe sie eine Weile nicht mehr benutzt.

Mein negativer Prompt lautet: „(extra fingers, deformed hands:1.15), (worst quality, low quality, poor quality, bad quality:1.35)“, den ich durch viel Experimentieren mit Stärken und Begriffen einzeln erarbeitet habe. Er sollte ziemlich gut funktionieren.

Das gibt mir Hoffnung, dass man die Handdarstellung in SD 1.5 tatsächlich lösen kann. Auch mit gutem Prompting erreiche ich nicht immer perfekte Ergebnisse, aber es kommt dem nahe. Für mich ist das Ziel erreicht, wenn das Modell gut geformte Hände ohne Ergänzungen im positiven oder negativen Prompt erzeugt.

Zurück zu eurem regulären Readme...

Ich teste die Theorie, dass MidJourney bessere Hände hat, weil sie gezielt ein Netzwerk auf hochwertigen Handbildern trainiert haben, was sonst niemand gemacht hat. Dieses LoRA ist noch nicht auf MidJourney-Niveau, aber ich habe es mehrere Nächte durchtrainiert und füge Bilder zum Datensatz hinzu, wo es Schwächen zeigt, und die Qualität verbessert sich stetig. Deshalb veröffentliche ich es jetzt, damit es benutzt werden kann. Man kann es als frühe Alpha sehen – Updates enden erst, wenn keine Verbesserung mehr stattfindet.

Beispielbilder sind sorgfältig ausgewählt. Bitte erwarte nicht, dass dieses Modell alle deine Hand-Generierungen verbessert. Einige können sich sogar verschlechtern, daher solltest du es über viele Bilder testen und nicht nur bei einem. Wenn es bei dir genauso funktioniert wie bei mir, sollten viele Ergebnisse gleich oder besser sein (manche werden nur anders schlecht).

Modell-Details

Diskussion

Bitte log in um einen Kommentar zu hinterlassen.