SD XL - v1.0

Palabras Clave y Etiquetas Relacionadas

Parámetros Recomendados

resolution

Consejos

El modelo está destinado para fines de investigación incluyendo generación de obras de arte, herramientas educativas y despliegue seguro.

No está destinado a generar representaciones factuales o verdaderas de personas o eventos.

Las limitaciones incluyen fotorrealismo imperfecto, incapacidad para generar texto legible, desafíos con indicaciones composicionales y posible generación incorrecta de rostros.

El modelo utiliza dos codificadores de texto preentrenados: OpenCLIP-ViT/G y CLIP-ViT/L.

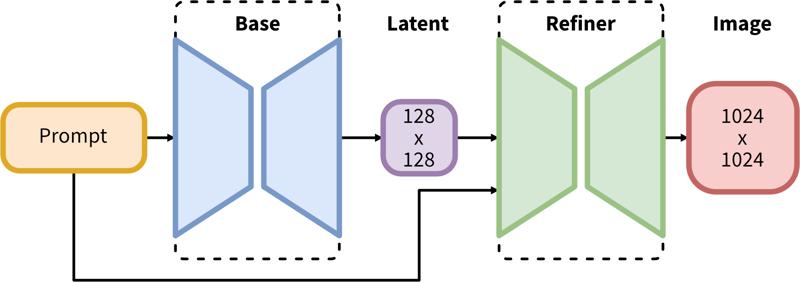

El flujo de trabajo en dos pasos incluye generación base de latentes seguida de refinamiento de alta resolución usando SDEdit (img2img).

Patrocinadores del Creador

Originalmente Publicado en Hugging Face y compartido aquí con permiso de Stability AI.

Originalmente Publicado en Hugging Face y compartido aquí con permiso de Stability AI.

SDXL consiste en un flujo de trabajo de dos pasos para la difusión latente: Primero, usamos un modelo base para generar latentes del tamaño de salida deseado. En el segundo paso, usamos un modelo especializado de alta resolución y aplicamos una técnica llamada SDEdit (https://arxiv.org/abs/2108.01073, también conocido como "img2img") a los latentes generados en el primer paso, usando el mismo prompt.

Descripción del Modelo

Desarrollado por: Stability AI

Tipo de modelo: Modelo generativo texto a imagen basado en difusión

Descripción del Modelo: Este es un modelo que puede usarse para generar y modificar imágenes basado en indicaciones de texto. Es un Modelo de Difusión Latente que utiliza dos codificadores de texto fijos y preentrenados (OpenCLIP-ViT/G y CLIP-ViT/L).

Recursos para más información: Repositorio GitHub.

Fuentes del Modelo

Repositorio: https://github.com/Stability-AI/generative-models

Demostración [opcional]: https://clipdrop.co/stable-diffusion

Usos

Uso Directo

El modelo está destinado solo para fines de investigación. Las posibles áreas y tareas de investigación incluyen

Generación de obras de arte y uso en procesos de diseño y otros procesos artísticos.

Aplicaciones en herramientas educativas o creativas.

Investigación sobre modelos generativos.

Despliegue seguro de modelos que puedan generar contenido dañino.

Exploración y comprensión de las limitaciones y sesgos de los modelos generativos.

Los usos excluidos se describen a continuación.

Uso Fuera de Alcance

El modelo no fue entrenado para representar hechos o verdades sobre personas o eventos, por lo que usar el modelo para generar dicho contenido está fuera del alcance de sus capacidades.

Limitaciones y Sesgos

Limitaciones

El modelo no alcanza un fotorrealismo perfecto

El modelo no puede generar texto legible

El modelo tiene dificultades con tareas más complejas que implican composicionalidad, como generar una imagen correspondiente a “Un cubo rojo encima de una esfera azul”

Las caras y personas en general pueden no generarse correctamente.

La parte de autoencodificación del modelo es con pérdida.

Sesgos

Aunque las capacidades de los modelos de generación de imágenes son impresionantes, también pueden reforzar o agravar sesgos sociales.

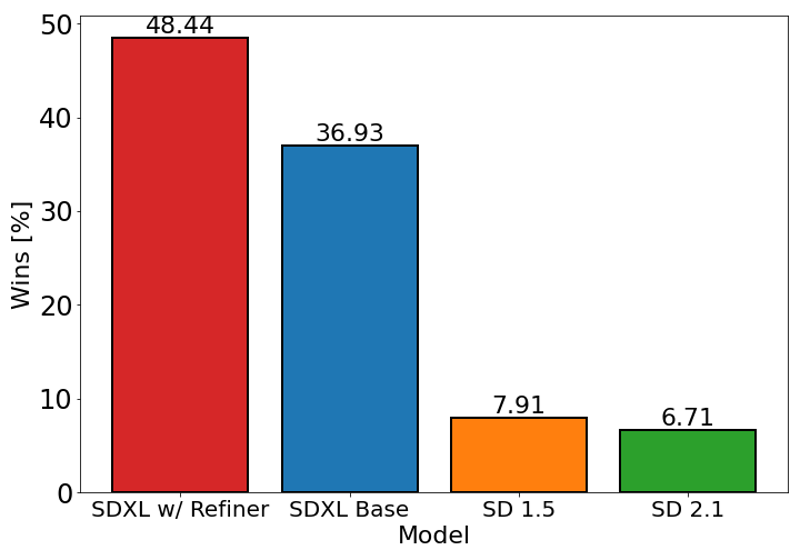

El gráfico anterior evalúa la preferencia del usuario por SDXL (con y sin refinamiento) en comparación con Stable Diffusion 1.5 y 2.1. El modelo base SDXL tiene un desempeño significativamente mejor que las variantes anteriores, y el modelo combinado con el módulo de refinamiento logra el mejor rendimiento general.

Detalles del Modelo

Tipo de modelo

Modelo base

Versión del modelo

Hash del modelo

Discusión

Por favor log in para dejar un comentario.