Colossus Project Flux - v10_int4_SVDQ

Mots-clés et tags associés

Prompts négatifs recommandés

blurry

Paramètres recommandés

samplers

steps

cfg

resolution

vae

Conseils

Utilisez un prompt négatif avec le mot 'flou' (blurry) pour améliorer la qualité de sortie.

Pour les versions FP4, utilisez uniquement les cartes graphiques Nvidia séries 50xx ; les versions int4 supportent les 40xx et en dessous (minimum série 20xx).

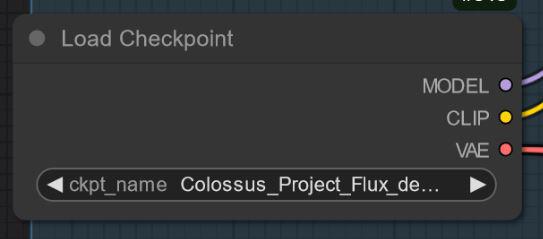

Les modèles 'Tout en un' contiennent Clip_l, T5xxl et VAE intégrés pour simplifier l'utilisation.

Essayez divers samplers tels Euler, Heun, DPM++2M, deis, DDIM ; scheduler 'Simple' recommandé.

Expérimentez avec l'échelle de guidance (cfg) de 1.5 à 3, par défaut autour de 2.2 à 2.3 pour de meilleurs résultats.

La version FP8 offre un bon équilibre entre qualité et performance.

Pour les versions spéciales ‘dé-distillées’, désactivez Flux Guidance scale et utilisez le cfg à la place.

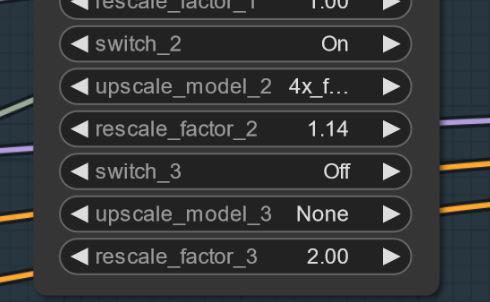

Si des artefacts apparaissent, essayez un petit upscale (ex. 1.14x au lieu de 1.2x) pour atténuer les problèmes.

Des workflows et guides détaillés sont fournis via des liens vers des articles Civitai.

Points forts de la version

Version V10_int4_SVDQ "Nunchaku"

Installation : Veuillez visiter mon guide d'installation/flux de travail : https://civitai.com/articles/15610

Tout d'abord, je tiens à remercier theunlikely https://huggingface.co/theunlikely qui a converti le FP16_Unet en int4_SVDQ. Visitez sa page et laissez un like.

Cette version est plus ou moins équivalente à la version FP8. Même en mode normal dans mon flux de travail, ce modèle est environ 2 à 3 fois plus rapide que le modèle classique... Avec le "mode rapide" du flux, je peux générer une image 2MP en environ 19 secondes avec ma 3090ti.

Qu'est-ce que SVDQ "Nunchaku" ?

Cette nouvelle méthode de quantification permet de réduire la taille des modèles Flux (dans ce cas un modèle FP16 natif) de 24GB à environ 6,7GB. Mais ce n'est pas tout : vous pouvez générer plus rapidement que jamais sans trop perdre en qualité. Bien sûr, une petite différence est visible par rapport à mon 32GB_Behemoth, mais pour ce modèle, beaucoup plus de VRAM/RAM est nécessaire pour le faire fonctionner.

Pour plus d'informations, visitez : https://github.com/mit-han-lab/ComfyUI-nunchaku?tab=readme-ov-file

Sponsors du créateur

Soutenez le créateur sur Ko-Fi : https://ko-fi.com/afroman4peace

Téléchargez les modèles quantifiés par Muyang Li de Nunchakutech : https://huggingface.co/nunchaku-tech/nunchaku-flux.1-dev-colossus

Guides de workflow sur Civitai :

https://civitai.com/articles/17313

https://civitai.com/articles/17358

https://civitai.com/articles/17163

https://civitai.com/articles/15610

https://civitai.com/articles/11950/workflow-for-colossus-project-flux-50

https://civitai.com/articles/8419

https://civitai.com/articles/7946

GitHub pour la quantification Nunchaku SVDQ : https://github.com/mit-han-lab/ComfyUI-nunchaku?tab=readme-ov-file

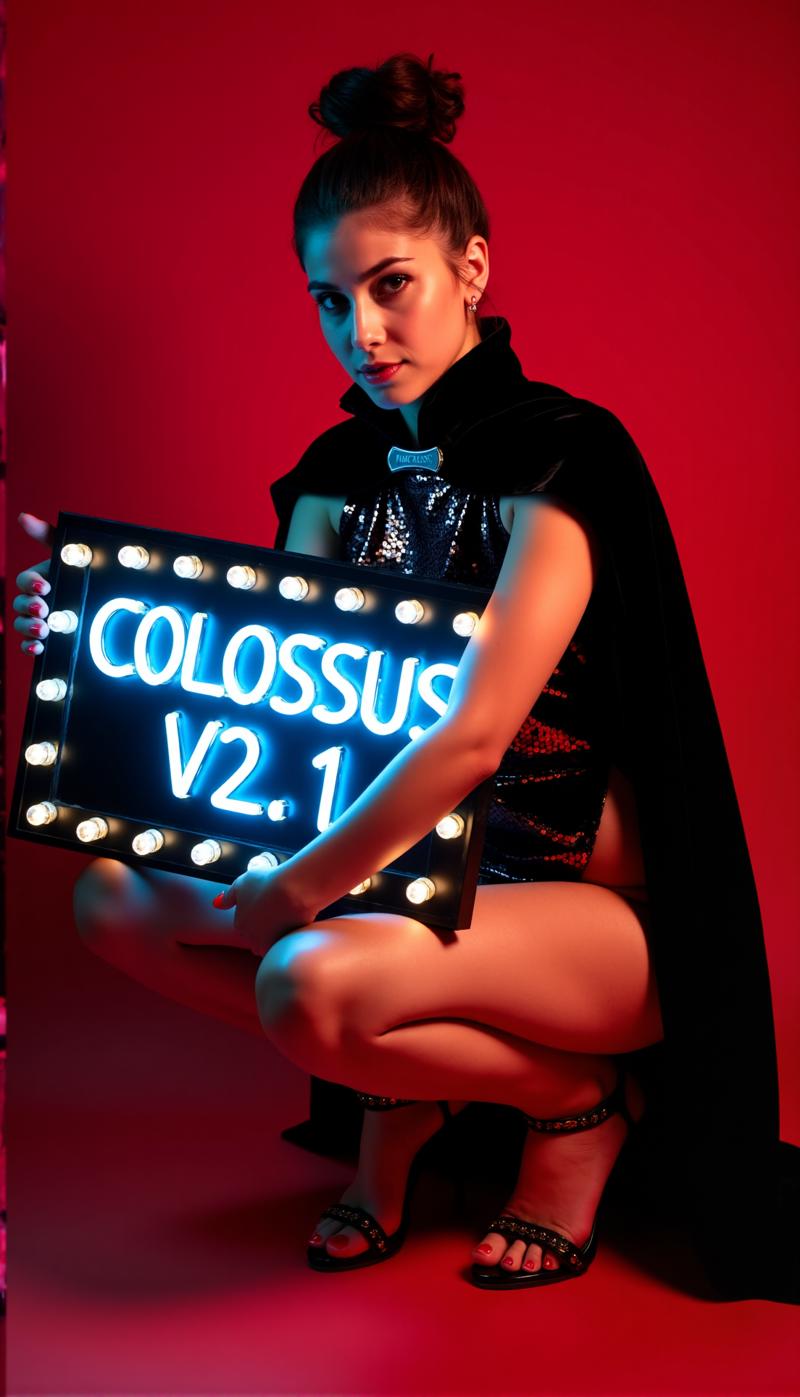

Au plus profond d'une montagne vit un géant endormi, capable soit d'aider l'humanité, soit de créer la destruction...

Un Colosse se lève...

Après ma série SDXL, c'est au tour de la série FLUX de ce projet... Cette fois, j'ai entraîné cette chose depuis le début. Pour l'entraînement, j'ai utilisé mes propres images. Je les ai créées avec mon modèle schnell Flux DemonFlux/Colossus Project schnell + mon SDXL Colossus Project 12 comme affiner.

Ce point de contrôle SD Flux est capable de produire presque tout... Colossus est très bon pour créer des images extrêmement réalistes, des animes et de l'art.

Si vous l'aimez, n'hésitez pas à me faire part de vos retours. Aussi si vous souhaitez me soutenir, vous pouvez le faire ici. J'ai investi pas mal d'argent pour construire un ordinateur capable de réellement entraîner des modèles Flux... L'entraînement et les tests prennent également beaucoup de temps et d'électricité...

https://ko-fi.com/afroman4peace

Version V12 "Hephaistos"

Publier ce point de contrôle me rend à la fois heureux et triste... V12 sera le dernier point de contrôle de cette série... La raison principale est la prochaine législation européenne sur l'IA... Une autre raison est la licence du Flux .1 DEV lui-même. Merci à tous pour le soutien ! J'ai consacré beaucoup de temps à ce projet cette dernière année. Il est maintenant temps de passer à un autre projet.

Quoi qu'il en soit... je vais terminer cette série sur une bonne note...

V12 est basé sur V10B "BOB" mais intègre essentiellement les meilleurs éléments de cette série fusionnés dans ce point de contrôle (c'était le résultat d'une nouvelle méthode de fusion prenant environ 1h30 et utilisant toute ma RAM de 128GB). J'ai aussi amélioré les textures du visage et de la peau par rapport à V10. Les yeux sont beaucoup plus réalistes et plus "vivants" qu'avant.

Testez-le vous-même et donnez-moi vos retours sur V12. "Merci" à ma connexion internet lente, je vais d'abord uploader le FP8_UNET. Ensuite la version FP8 "tout en un", puis FP16_unet et FP16_BEHEMOTH. J'essaierai aussi de convertir en int4 et fp4 (souhaitez-moi bonne chance).

Comme toujours, donnez-moi vos retours sur V12...

Version V12 "Behemoth" (AIO)

Ce modèle "tout en un" est le meilleur de ma série V12... et aussi le plus volumineux bien sûr :-)

Le Behemoth inclut un T5xxl personnalisé et Clip_l incorporés dans le modèle. Si vous privilégiez la qualité à la quantité, c'est le point de contrôle pour vous !

Version V12 FP4/int4

Merci à Muyang Li de Nunchakutech qui a réalisé la quantification de V12. https://huggingface.co/nunchaku-tech et leur incroyable nunchaku !

Cette version est vraiment impressionnante. Elle combine qualité et rapidité inédites.

ATTENTION !

Il existe deux versions FP4 et int4. FP4 est uniquement pour les cartes graphiques Nvidia séries 50xx ! Tandis que int4 fonctionne avec les 40xx et en dessous. (vous avez besoin d'au moins une carte graphique série 20xx)

Vous pouvez aussi télécharger les deux versions directement ici : https://huggingface.co/nunchaku-tech/nunchaku-flux.1-dev-colossus

GUIDE D'INSTALLATION et FLUX DE TRAVAIL

Voici un guide d'installation rapide et un flux de travail en cours.

https://civitai.com/articles/17313

GUIDE DÉTAILLÉ pour le Flux de travail

https://civitai.com/articles/17358

Je travaille encore sur mes nouveaux flux de travail pour Nunchaku... donc le flux suivant est toujours très WIP (work in progress). J'ajouterai un article détaillé ce week-end.

Version V12 FP16_B_variant

À cause d'une petite erreur que j'ai faite tard dans la nuit (2h du matin), j'ai renommé et uploadé le mauvais point de contrôle. C'est un point de contrôle très expérimental jamais destiné à être publié. Il n'a pas été beaucoup testé mais a très bien fonctionné lors de la création de la vitrine. Il pourrait être meilleur que la version standard.

Il tend à privilégier les visages asiatiques... C'est parce que je voulais tester quelque chose à intégrer dans un projet secondaire sur lequel je travaille encore. Dites-moi vos expériences avec ce point de contrôle :-)

Version V12 AIO FP8

Cette version est une version tout en un de V12. Cela signifie que tous les clips sont intégrés. Elle donnera le même rendu que le FP8_unet avec mon Clip_l personnalisé.

Version V12 GGUF Q5_1

Cette version était une demande. La qualité n'est pas mauvaise...

Version V10B "BOB"

C'est une version alternative de V10. Je l'ai créée pour améliorer la version FP8 de V10. En général, la version FP8 est plus précise et les couleurs sont meilleures. Malheureusement, je n'ai pas eu beaucoup de temps récemment... (la vie réelle passe en premier). C'est pourquoi cela a pris autant de temps... Dites-moi si vous préférez cette version. J'ai aussi une version FP16 de "BOB". Selon les retours, je pourrais envisager aussi de publier une version int4.

FLUX DE TRAVAIL :

Voici le flux de travail pour V12 et V10 : https://civitai.com/articles/17163

Version V10_int4_SVDQ "Nunchaku"

Tout d'abord, je tiens à remercier theunlikely https://huggingface.co/theunlikely qui a converti le FP16_Unet en int4_SVDQ. Visitez sa page et laissez un like.

Cette version est plus ou moins équivalente à la version FP8. Même en mode normal dans mon flux de travail, ce modèle est environ 2 à 3 fois plus rapide que le modèle classique... Avec le "mode rapide" du flux, je peux générer une image 2MP en environ 19 secondes avec ma 3090ti.

Qu'est-ce que SVDQ "Nunchaku" ?

Cette nouvelle méthode de quantification permet de réduire la taille des modèles Flux (dans ce cas un modèle FP16 natif) de 24GB à environ 6,7GB. Mais ce n'est pas tout : vous pouvez générer plus rapidement que jamais sans trop perdre en qualité. Bien sûr, une petite différence est visible par rapport à mon 32GB_Behemoth, mais pour ce modèle, beaucoup plus de VRAM/RAM est nécessaire pour le faire fonctionner.

Pour plus d'informations, visitez : https://github.com/mit-han-lab/ComfyUI-nunchaku?tab=readme-ov-file

Installation : Veuillez visiter mon guide d'installation/flux de travail : https://civitai.com/articles/15610

Version V10 "Behemoth" (FP16_AIO)

Cette version est encore expérimentale. L'objectif principal était d'obtenir des résultats plus réalistes. J'ai également réussi à réduire certaines "lignes Flux". Ce modèle est basé sur Colossus Project V5.0_Behemoth, V9.0 et un autre projet que j'appelle "Ouroborus Project".

La version FP16 est très stable. Une version FP8 sera bientôt disponible. Cette dernière est aussi très bonne mais moins stable.

Je vous laisse expérimenter avec elle... Dites-moi ce que vous en pensez.

Amusez-vous à créer :-)

Version V9.0 :

Eh bien, je dois beaucoup expliquer... Pourquoi est-ce déjà V9.0 ?

J'ai récemment emménagé dans un nouvel appartement et en raison d'erreurs du fournisseur internet, je n'avais pas de connexion Internet fiable... Donc pendant tout le déménagement... j'ai laissé mon ordinateur allumé. Résultat : j'ai créé beaucoup (la plupart corrompus) de points de contrôle. J'ai cependant quelques bonnes versions V8 que je pourrais publier aussi...

Qu'est-ce qui a changé ?

J'ai intégré de nouveaux visages et textures de peau en prenant essentiellement les meilleurs résultats de V5.0. Le modèle a aussi bénéficié d'un entraînement sur pieds/jambes pour une meilleure anatomie. Les versions V5.0 pouvaient parfois couper la tête et les pieds... Je pense avoir corrigé certains de ces problèmes...

De plus, je l'ai entraîné avec davantage d'images de paysages personnels... Et oui, j'ai fait tout cela pendant le déménagement... Le temps d'entraînement total est d'environ 2 semaines de calcul, ce qui n'est pas donné... (chaque heure me coûte environ 25 centimes d'électricité).

J'espère que vous apprécierez cette version... Si vous souhaitez me soutenir : postez de belles images ou même un pourboire via Buzz ou Ko-fi...

Dites-moi ce que vous en pensez :-)

Version 5.0 :

La V5.0 est en fait basée sur les V4.2 et V4.4 (qui seront aussi bientôt publiées). Elle dispose d'un entraînement supplémentaire sur les détails de la peau et l'anatomie en général, ce qui corrige notamment mains et tétons. Les détails du visage sont bien meilleurs. J'ai aussi essayé de réduire certaines petites lignes flux...

En général, cette version est plus réaliste que la V4.2 et meilleure sur les petits détails... Comme la V4.2, cette version est aussi un modèle hybride dé-distillé. Vous pouvez l'utiliser avec les mêmes réglages que pour la V4.2.

Voici aussi un nouveau flux de travail pour expérimenter : https://civitai.com/articles/11950/workflow-for-colossus-project-flux-50

Dites-moi ce que vous pensez de cette version comparée à 4.2 ou V2.1...

Version 4.4 "Research" :

J'ai ajouté cette version pour compléter... Elle est légèrement plus réaliste que la V4.2 et constitue la base de la version 5.0. Vous pouvez l'essayer si vous voulez. Le flux pour V5.0 et V4.2 fonctionne aussi...

Version 4.2 :

Cette version est essentiellement une évolution de Demoncore Flux et Colossus Project Flux. L'objectif était d'obtenir un résultat plus stable avec de meilleures textures de peau, de meilleures mains et plus de variété de visages. Je l'ai donc entraînée sur un modèle hybride incluant en partie Demoncore Flux. J'ai aussi amélioré les tétons et le contenu NSFW un peu. Dites-moi si vous préférez la V4.2 à la version 2.1 :-)

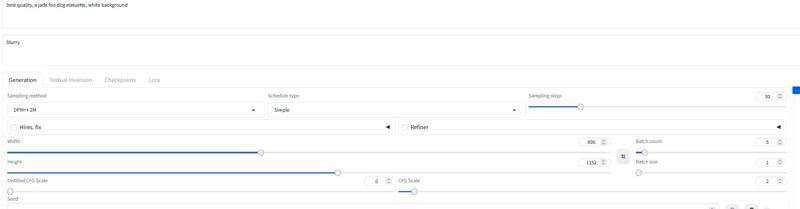

Pour les images de démonstration : je n'ai utilisé que des images natives avec résolution SDXL ou 2MP (par exemple 1216x1632). Ce modèle peut gérer des résolutions encore plus grandes... J'ai testé ce point de contrôle jusqu'à 2500x2500 mais je recommande plutôt d'utiliser environ 2000x2000.

Pour les réglages, je conseille d'utiliser environ 30 steps et 2-2.5 cfg. J'utilise principalement 2.2 ou 2.3 dans mon flux. Pour la démonstration, j'ai utilisé DPM++ 2M avec ordonnancement simple.

Je vais ajouter d'autres versions bientôt, mais je n'ai pas beaucoup de temps avant Noël...

Paramètres

J'ajouterai bientôt un nouveau flux dédié Comfy. Vous pouvez toujours télécharger et ouvrir les images de démonstration en attendant...

La version "Tout en un" fonctionne aussi bien avec Forge...

En gros, elle utilise les mêmes réglages que la version 2.1 (voir ci-dessous)

Utilisez 20-30 steps avec un cfg autour de 2.2...

Version 2.1_de-distilled_experimental (MERGE)

Cette version est complètement différente et fonctionne en fait différemment d'un modèle Flux normal !

C'est une fusion expérimentale entre ma version 2.0 et une version dé-distillée https://huggingface.co/nyanko7/flux-dev-de-distill. Cela s'est fait un peu par accident mais les résultats sont époustouflants. Vous obtiendrez des détails impressionnants. Le modèle suit aussi très bien les prompts... La prochaine étape sera de l'entraîner directement sur le modèle dé-distillé. J'ai déjà fait des tests avec des Loras. C'est très expérimental donc faites-moi savoir si vous trouvez des erreurs non listées ci-dessous. Si vous avez de bonnes images, postez-les... postez aussi les mauvaises, cela aide à améliorer :-). Essayez aussi la version 2.0 et dites-moi quel type de point de contrôle vous convient le mieux.

!Attention!

Le flux normal Flux ne fonctionne pas avec cette version. VOUS DEVEZ télécharger mon flux pour celle-ci !

Vous pouvez aussi essayer de vous débrouiller vous-même mais ne me blâmez pas pour de mauvaises images. C'est un modèle très expérimental... vérifiez les inconvénients ci-dessous...

Avantages et inconvénients de ce point de contrôle :

Ce point de contrôle peut créer des détails extrêmes... Cela a un coût... Il est lent comparé aux points de contrôle Flux normaux. L'avantage est que souvent, vous n'avez plus besoin d'upscale supplémentaire. Au lieu d'utiliser Flux Guidance, ce modèle utilise l'échelle cfg. Ce qui signifie aussi qu'il ne fonctionne pas avec les flux standard.

Vous pouvez utiliser des prompts négatifs ! Cela aide à éliminer les éléments indésirables de l'image.

Des artefacts peuvent parfois apparaître... Vous pouvez les corriger par un petit upscale simple (je travaille sur cela). Voici un exemple... cela arrive bizarrement pas avec toutes les graines... MISE À JOUR : ce n'est pas un problème du modèle en lui-même... plutôt un problème de flux... Je travaille à une correction. Si cela arrive, vous pouvez essayer de régler le premier upscale à 1.14 au lieu de 1.2.

Paramètres et flux V2.1 :

Voici le flux pour celui-ci : https://civitai.com/articles/8419

Paramètres : Contrairement au flux Flux normal, il n'a pas besoin de Flux Guidance scale. Utilisez plutôt le cfg. Je l'utilise principalement à 3 cfg dans le workflow... Certaines images peuvent nécessiter un cfg plus bas.

Le plus important est de désactiver l'échelle Flux Guidance...

Sans le workflow, je l'ai testé avec 30 steps et 2-3 cfg. C'est peut-être aussi les réglages pour Forge. Essayez d'expérimenter.

Je recommande d'utiliser le mot "flou" (blurry) dans les négatifs.

Sampler et scheduler :

Vous pouvez choisir parmi plusieurs samplers :

Euler, Heun, DPM++2m, deis, DDIM fonctionnent très bien.

J'utilise surtout "simple" comme scheduler.

Si vous trouvez de meilleurs réglages, dites-le-moi... :-)

Pour Forge, je recommande le modèle AIO... voici un exemple de réglage pour Forge :

Version 2.0_dev_experimental

Eh bien... c'est une version expérimentale... L'objectif était de créer un modèle plus cohérent et plus rapide. J'ai intégré des loras que j'avais entraînées moi-même, puis fusionné les modèles résultants d'une manière spéciale (fusion tensorielle). Il dispose d'un T5xxl personnalisé modifié avec "Attention Seeker". Pour gagner en vitesse et qualité, j'ai fusionné le lora Hyper Flux de ByteDance. Cela a déplacé la zone de travail... Je vous montre ce que cela signifie... Voici l'image principale du titre...

16 steps V 2.0

30 steps V 1.0

30 steps V 1.0

Inconvénients :

Inconvénients :

Premièrement... cette version est un peu plus grosse que la précédente... Deuxièmement, je dois encore créer la version uniquement Unet. Je mettrai à jour quand ce sera fait.

Paramètres et flux de travail V2.0 :

Vous pouvez maintenant exécuter le modèle avec moins de steps... 16 steps équivalent à 30 steps de l'ancien modèle.

Je recommande toutefois d'utiliser environ 20-30 steps, car cela donne en général plus de qualité.

Sampler : Je préfère Euler avec scheduler Simple. Le guidance peut être réglé entre 1.5 et 3 (à tester en dehors de cette plage aussi). Le guidance à 1.8 fonctionne bien pour les images réalistes. Vous pouvez aussi tester d'autres samplers. DPM++2M et Heun fonctionnent aussi très bien.

Flux de travail 2.0 :

J'ai créé un nouveau flux pour V2.0 et V1.0. Il inclut le nouveau générateur de prompt Flux. J'ai aussi activé la deuxième étape d'upscale. https://civitai.com/articles/7946

Forge :

J'ai testé ce modèle avec Forge et il a très bien fonctionné... Les images peuvent différer entre Comfy UI et Forge cependant...

Version 1.0_dev_beta :

Ce modèle est ma première entrée dans la série. Veuillez donc me faire des retours et poster des images. Cela m’aide à améliorer ce projet. Plusieurs versions sont disponibles. Le meilleur modèle en termes de qualité est la version FP16. Cette version FP16 est très volumineuse et nécessite une carte graphique puissante et beaucoup de RAM. La version FP8 est celle que je considère comme un bon compromis qualité/performance. Pour obtenir une version GGUF, téléchargez Q8_0. Les versions GGUF Q4_0/4.1 étaient une demande. Elles sont petites mais perdent un peu en qualité.

Il existe essentiellement deux types de mes modèles : les modèles « Tout en un » nécessitant un seul fichier à télécharger. Ils contiennent Clip_l, T5xxl fp8 et le VAE intégrés (voir ci-dessous). Placez-le dans votre dossier checkpoints.

Les autres versions sont uniquement UNET. Vous devez charger tous les fichiers séparément.

Dans tous les cas, vous devez télécharger mon Clip_L pour qu'ils fonctionnent correctement.

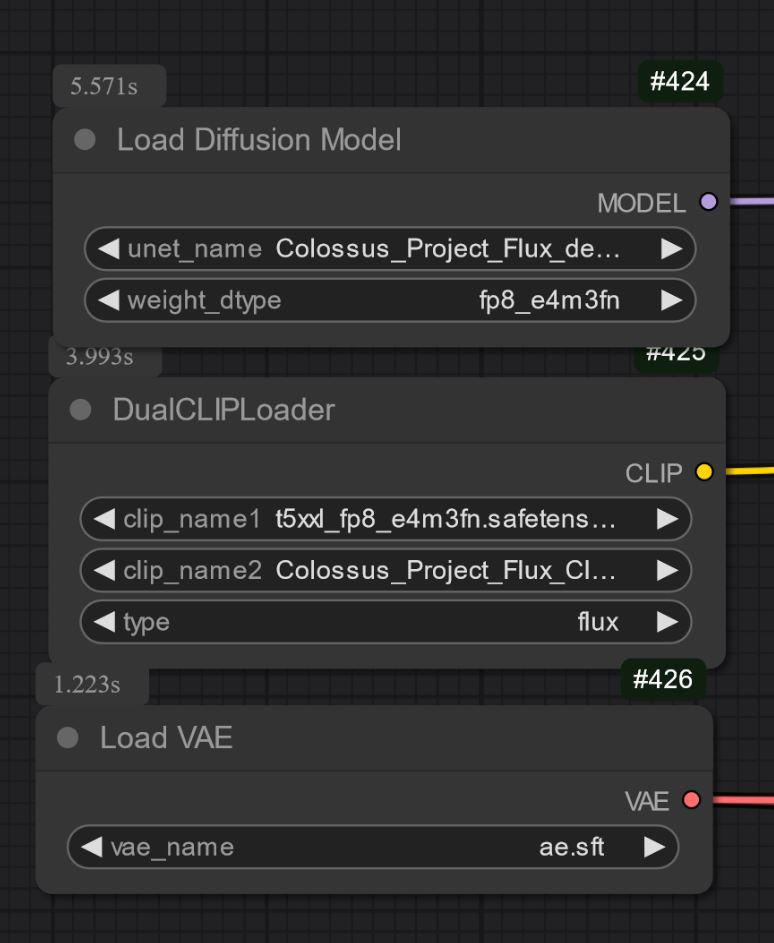

Il est aussi important de choisir le bon clip T5xxl. Pour la version FP8, il s'agit du clip fp8_e4m3fn t5xxl. Pour la FP16, il s'agit du clip FP16. Assurez-vous de sélectionner le type de poids par défaut. (image exemple ci-dessous pour la version fp8)

Pour la version GGUF, vous avez besoin du loader GGUF !

Quelques points connus pour l'instant concernant la V1.0 :

C'est le premier modèle de la série, donc il peut rencontrer des difficultés avec certains prompts ou styles comme l'art. La prochaine version recevra plus d'entraînement. Dites-moi ce que le modèle ne peut pas faire...

Paramètres et flux de travail :

Je l'ai testé avec environ 30 steps, Euler et scheduler Simple. Le guidance peut être réglé entre 1.5 et 3 (testez aussi en dehors de cette plage).

Le guidance à 1.8 fonctionne bien pour des images réalistes.

N'hésitez pas à expérimenter avec ces réglages... Si vous obtenez de bons résultats, postez-les.

J'ai ajouté les images de vitrine comme données d'entraînement... Le flux de travail Comfy est inclus. Voici le lien pour télécharger le workflow : https://civitai.com/articles/7946

Modèle "Tout en un" :

UNET uniquement :

Vous devez aussi télécharger le clip_L. C'est un fichier de 240 Mo.

Vous devez aussi télécharger le clip_L. C'est un fichier de 240 Mo.

GGUF : J'ai ajouté le flux pour GGUF ici : https://civitai.com/articles/7946

Important :

Le modèle dev n'est pas destiné à un usage commercial. Pour cela, je publierai le modèle "schnell" ailleurs. Il est plutôt prévu pour un usage personnel ou scientifique.

LICENCE :

https://huggingface.co/black-forest-labs/FLUX.1-dev/blob/main/LICENSE.md

Crédits :

theunlikely https://huggingface.co/theunlikel (merci encore)

Version 2.1/V4.2/5.0 : Flux_dev_de-distill de nyanko7

https://huggingface.co/nyanko7/flux-dev-de-distill

Depuis V2.0 : Hyper Lora de ByteDance https://huggingface.co/ByteDance/Hyper-SD

Black Forrest pour leur incroyable modèle Flux https://huggingface.co/black-forest-labs

Détails du modèle

Type de modèle

Modèle de base

Version du modèle

Hash du modèle

Créateur

Discussion

Veuillez vous log in pour laisser un commentaire.

Collection de modèles - Colossus Project Flux

Colossus Project Flux - v12_int4_SVDQ_nunchaku

Colossus Project Flux - V12 "Hephaistos" FP8_UNET

Colossus Project Flux - v10_AIO_FP8