Anime Illust Diffusion XL - v0.61

Parole Chiave e Tag Correlati

Prompt Consigliati

Trigger word (by xxx),a girl named frieren from sousou no frieren series,best quality,beautiful color,detailed,aesthetic,impasto style,cowboy shot,fantasy theme,gradient background,sitting on ground,expressionless,white hair,twintails,green eyes,parted lip,white dress,frills,a cat,grass,sunshine

best quality, 1girl, solo, looking at viewer, bangs

Prompt Negativi Consigliati

(worst quality:1.3),low quality,lowres,messy,abstract,ugly,disfigured,bad anatomy,draft,deformed hands,fused fingers,signature,text,multi views

aidxlv05_neg

Parametri Consigliati

samplers

steps

cfg

resolution

vae

Parametri Consigliati per Alta Risoluzione

denoising strength

Suggerimenti

Riduci il peso per le parole di attivazione dello stile dell'artista, ad esempio (by xxx:0.6).

Ordinare i tag nel prompt aiuta il modello a comprendere meglio il significato; l'ordine consigliato è fornito.

Usa 'rifinisci' (image2image o inpainting) se le uscite text2image sono sfocate.

Per la fusione degli stili, controlla peso e ordine degli stili e aggiungi i tag alla fine del prompt, non all'inizio.

Le parole di attivazione dei personaggi solitamente non includono l'abbigliamento; aggiungi i tag di abbigliamento separatamente.

Per le versioni 0.61 e precedenti, usa embeddings testuali negativi specializzati per il modello per i migliori risultati.

Assicurati che il totale dei pixel sia vicino a 1024x1024 e che le dimensioni siano multipli di 32 per una generazione ottimale.

Punti Salienti della Versione

Stilizzazione più marcata.

Inoltre, ho aggiunto rumore aggiuntivo durante l'addestramento. Alcuni campionatori non raggiungono lo zero al passo finale, causando rumore nell'immagine generata. Quindi, Euler A o il campionatore Euler potrebbero essere più adatti.

风格化更明显。

另外,我在训练中使用了附加噪声。部分采样器的最终时间步不会归零,因此可能导致生成的图像带有噪声。因此,Euler A 或 Euler 采样器可能更适合您使用。

Sponsor del Creatore

Se ti piace il nostro lavoro, sostienici tramite Ko-fi: https://ko-fi.com/eugeai

Grazie alla community @NieTa (nieta.art) per il supporto di potenza di calcolo, e grazie a @KirinTea_Aki (profilo Civitai) e @Chenkin (profilo Civitai) per il supporto dati.

Introduzione al modello (parte in inglese)

I Contenuti

In questa introduzione imparerai riguardo a:

Informazioni sul modello (vedi Sezione II);

Istruzioni per l'uso (vedi Sezione III);

Parametri di addestramento (vedi Sezione IV);

Elenco delle parole di attivazione (vedi Appendice Parte A)

II AIDXL

Anime Illustration Diffusion XL, o AIDXL, è un modello dedicato alla generazione di illustrazioni anime stilizzate. Dispone di oltre 800 (in continuo aumento con gli aggiornamenti) stili incorporati, attivati da parole di attivazione specifiche (vedi Appendice A).

Vantaggi:

Composizione flessibile invece delle pose tradizionali AI.

Dettagli abili invece di caos disordinato.

Conoscenza migliore dei personaggi anime.

III Guida per l'utente

1 Uso base

1.1 Prompt

Parole di attivazione: Aggiungi le parole di attivazione fornite in Appendice A per stilizzare l'immagine. Parole di attivazione adatte miglioreranno notevolmente la qualità;

Si consiglia di ridurre il peso alle parole di attivazione relative allo stile dell'artista, ad esempio (by xxx:0.6).

Ordinamento semantico: Ordinare i tag o le frasi del prompt aiuta il modello a comprendere il significato.

Ordine consigliato dei tag: Parola di attivazione (by xxx) -> personaggio (una ragazza chiamata frieren dalla serie sousou no frieren) -> razza (elfo) -> composizione (cowboy shot) -> stile (impasto ) -> tema (tema fantasy) -> ambiente principale (nel bosco, di giorno) -> sfondo (sfondo sfumato) -> azione (seduta a terra) -> espressione (senza espressione) -> caratteristiche principali (capelli bianchi) -> caratteristiche del corpo (codini, occhi verdi, labbro fessurato) -> abbigliamento (indossa un vestito bianco) -> accessori per abbigliamento (volant) -> altri oggetti (un gatto) -> ambiente secondario (erba, sole) -> estetica (colori belli, dettagliato, estetico) -> qualità ((best quality:1.3))

Prompt negativi: (worst quality:1.3), low quality, lowres, messy, astratto, brutto, deturpato, anatomia errata, abbozzo, mani deformate, dita fuse, firma, testo, viste multiple

1.2 Parametri di generazione

Risoluzione: Assicurati che il numero totale di pixel (=larghezza * altezza) sia intorno a 1024*1024 e che larghezza e altezza siano divisibili per 32, così AIDXL produrrà il miglior risultato. Ad esempio, 832x1216 (2:3), 1216x832 (3:2) e 1024x1024 (1:1).

Campionatore e passi: Usa il campionatore "Euler Ancester", chiamato Euler A nel webui. Campiona circa ~28 passi con 7 a 9 scala CFG.

'Rifinire': L'immagine generata da text2image a volte è sfocata, in questo caso è necessario 'rifinirla' usando image2image o inpainting ecc.

Per semplice ingrandimento, puoi consultare: Upscale a dimensioni enormi e aggiungi dettagli con SD Upscale, è facile! : r/StableDiffusion (reddit.com)

Altri componenti: Non c'è bisogno di usare alcun modello refiner. Usa il VAE del modello stesso o il

sdxl-vae.

D: Come riprodurre la copertina del modello? Perché non riesco a ottenere la stessa immagine della copertina usando gli stessi parametri di generazione?

R: Perché i parametri di generazione mostrati nella copertina non sono quelli di text2image , ma quelli di image2image (per ingrandire). L'immagine base è principalmente generata dal campionatore Euler Ancester piuttosto che dal campionatore DPM.

2 Uso speciale

2.1 Stili generalizzati

Dalla versione 0.7, AIDXL riassume diversi stili simili e introduce parole di attivazione stili generalizzati. Queste parole rappresentano ciascuna una categoria comune di stili di illustrazione anime. Nota che queste parole di attivazione generali non necessariamente seguono il significato artistico originale, ma sono parole di attivazione speciali ridefinite.

2.2 Personaggi

Dalla versione 0.7, AIDXL ha migliorato l'addestramento per i personaggi. L'effetto di alcune parole di attivazione dei personaggi può già raggiungere l'effetto di Lora e può ben separare il concetto del personaggio dal suo abbigliamento.

Il metodo di attivazione del personaggio è: {character} \({copyright}\). Ad esempio, per attivare l'eroina Lucy nell'animazione "Cyberpunk: Edgerunners", usa lucy \(cyberpunk\); per attivare il personaggio Gan Yu nel gioco "Genshin Impact", usa ganyu \(genshin impact\). Qui, "lucy" e "ganyu" sono nomi di personaggi, "\(cyberpunk\)" e "\(genshin impact\)" sono le origini dei rispettivi personaggi, e le parentesi sono scappate con barre "\" per evitare che siano interpretate come tag ponderati. Per alcuni personaggi, la parte del copyright non è necessaria.

Dalla versione v0.8, c'è un metodo di attivazione più semplice: una {ragazza/ragazzo} chiamato {personaggio} dalla serie {copyright}.

Per la lista delle parole di attivazione dei personaggi, si prega di consultare: selected_tags.csv · SmilingWolf/wd-v1-4-convnext-tagger-v2 at main (huggingface.co). Inoltre, alcune parole di attivazione extra non menzionate in questo documento potrebbero essere incluse.

Alcuni personaggi richiedono un passaggio extra di attivazione. Quando si usa, se il personaggio non può essere completamente riprodotto con una singola parola di attivazione, le caratteristiche principali del personaggio devono essere aggiunte al prompt.

AIDXL supporta la vestizione dei personaggi. Le parole di attivazione dei personaggi solitamente non includono il concetto delle caratteristiche dell'abbigliamento del personaggio stesso. Se si desidera aggiungere l'abbigliamento, è necessario aggiungere il tag dell'abbigliamento nel prompt. Ad esempio, silver evening gown, plunging neckline fornisce il vestito del personaggio St. Louis (Luxurious Wheels) dal gioco Azur Lane. Allo stesso modo, puoi aggiungere tag di abbigliamento di qualsiasi personaggio a quelli di altri personaggi.

2.3 Tag di qualità

I tag di qualità e di estetica sono formalmente addestrati. Inserirli nel prompt influirà sulla qualità dell'immagine generata.

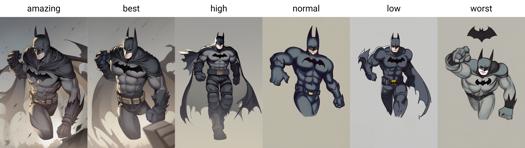

Dalla versione 0.7, AIDXL addestra ufficialmente e introduce i tag di qualità. Le qualità sono divise in sei livelli, dalla migliore alla peggiore: amazing quality, best quality, high quality, normal quality, low quality e worst quality.

Si consiglia di aggiungere un peso extra ai tag di qualità, ad esempio (amazing quality:1.5).

2.4 Tag di estetica

Dalla versione 0.7, sono stati introdotti i tag di estetica per descrivere le caratteristiche estetiche speciali delle immagini.

2.5 Fusione degli stili

Puoi unire alcuni stili nel tuo stile personalizzato. 'Fondere' significa effettivamente usare più parole di attivazione di stile contemporaneamente. Ad esempio, chun-li, amazing quality, (by yoneyama mai:0.9), (by chi4:0.8), by ask, by modare, (by ikky:0.9).

Alcuni suggerimenti:

Controlla il peso e l'ordine degli stili per regolare il risultato.

Aggiungi i tag in coda, non in testa, al prompt.

IV Strategia di addestramento e parametri

AIDXLv0.1

Usando SDXL1.0 come modello base, con circa 22k immagini etichettate per circa 100 epoche su un pianificatore coseno con un tasso di apprendimento di 5e-6 e un numero di cicli = 1 si ottiene il modello A. Poi, con un tasso di apprendimento di 2e-7 e gli stessi altri parametri si ottiene il modello B. Il modello AIDXLv0.1 si ottiene fondendo i modelli A e B.

AIDXLv0.51

Strategia di addestramento

Riprende l'addestramento da AIDXLv0.5, con tre fasi di addestramento in sequenza:

Addestramento con didascalie lunghe: Usa l'intero dataset, con alcune immagini etichettate a mano. Inizia l'addestramento sia di U-Net che dell'encoder testuale con l'ottimizzatore AdamW8bit, tasso di apprendimento alto (circa 1.5e-6) con pianificatore coseno. Interrompi l'addestramento quando il tasso di apprendimento scende sotto una soglia (circa 5e-7).

Addestramento con didascalie corte: Riavvia l'addestramento dall'output del passo 1 con gli stessi parametri ma con un dataset con didascalie più corte.

Fase di raffinamento: Prepara un sottoinsieme del dataset del passo 1 contenente immagini di alta qualità selezionate a mano. Riavvia l'addestramento dall'output del passo 2 con un tasso di apprendimento basso (circa 7.5e-7), con pianificatore coseno con riavvii da 5 a 10 turni. Addestra fino a ottenere risultati esteticamente buoni.

Parametri di addestramento fissi

Nessun rumore extra come offset di rumore.

Gamma snr minimo = 5: accelera l'addestramento.

Precisione completa bf16.

Ottimizzatore AdamW8bit: bilancia efficienza e prestazioni.

Dataset

Risoluzione: 1024x1024 totale (= altezza per larghezza) con strategia di bucketing SDXL modificata ufficialmente.

Didascalie: etichettate dal modello WD14-Swinv2 con soglia 0.35.

Ritaglio ravvicinato: taglia immagini in diversi primi piani. Molto utile se le immagini di addestramento sono grandi o rare.

Parole di attivazione: conserva il primo tag delle immagini come parole di attivazione.

AIDXLv0.6

Strategia di addestramento

Riprende l'addestramento da AIDXLv0.52, ma con una strategia adattativa di ripetizione - per ogni immagine etichettata nel dataset, aumenta il numero di ripetizioni nell'addestramento secondo le seguenti regole:

Regola 1: Maggiore è la qualità dell’immagine, maggiore è il numero di ripetizioni;

Regola 2: Se l’immagine appartiene a una classe di stile:

Se la classe non è ancora adattata o sottadattata, allora aumenta manualmente il numero di ripetizioni della classe, oppure aumenta automaticamente le ripetizioni fino a raggiungere un valore prestabilito (circa 100).

Se la classe è già adattata o soveradattata, allora diminuisci manualmente il numero di ripetizioni a 1 e scartala se la qualità è bassa.

Regola 3: Limita il numero massimo di ripetizioni a una soglia definita, circa 10.

Questa strategia ha i seguenti vantaggi:

Protegge le informazioni originali del modello da nuovi training, mantenendo il concetto di regolarizzazione delle immagini;

Rende più controllabile l’impatto dei dati di addestramento;

Bilancia l’addestramento tra classi diverse motivando le classi non ancora adattate e prevenendo l’overfitting per quelle già adattate;

Risparmia significativamente risorse computazionali e rende molto più facile aggiungere nuovi stili al modello.

Parametri di addestramento fissi

Uguali a quelli di AIDXLv0.51.

Dataset

Il dataset di AIDXLv0.6 si basa su quello di AIDXLv0.51. Inoltre, applica le seguenti ottimizzazioni:

Ordinamento semantico delle didascalie: ordina i tag secondo l’ordine semantico, ad esempio "gun, 1boy, holding, short hair" -> "1boy, short hair, holding, gun".

Rimozione di duplicati nelle didascalie: rimuove tag duplicati mantenendo quello con più informazioni. Tag duplicati sono tag con significato simile, come "long hair" e "very long hair".

Tag extra: aggiunge manualmente tag addizionali a tutte le immagini, come "high quality", "impasto" ecc. Può essere fatto rapidamente con alcuni strumenti.

V Ringraziamenti speciali

Sponsorizzazione potenza di calcolo: grazie alla community @NieTa (捏Ta (nieta.art)) per il supporto di potenza computazionale;

Supporto dati: grazie a @KirinTea_Aki (Profilo creatore KirinTea_Aki | Civitai) e @Chenkin (Civitai | Condividi i tuoi modelli) per il grande supporto dati;

Non ci sarebbe stata la versione 0.7 senza di loro.

VI AIDXL vs AID

2023/08/08. AIDXL è addestrato sullo stesso set di addestramento di AIDv2.10, ma supera AIDv2.10. AIDXL è più intelligente e può fare molte cose che i modelli basati su SD1.5 non possono. Fa anche un ottimo lavoro nel distinguere concetti, apprendere dettagli dell’immagine e gestire composizioni difficili o impossibili per SD1.5 e AID. In generale, ha un potenziale assoluto. Continuerò ad aggiornare AIDXL.

VII Sponsorizzazione

Se ti piace il nostro lavoro, sei invitato a sostenerci tramite Ko-fi(https://ko-fi.com/eugeai) per supportare la nostra ricerca e sviluppo. Grazie per il tuo supporto~

Introduzione al modello (Parte in cinese)

I Indice

In questa introduzione, imparerai:

Introduzione al modello (vedi parte II);

Guida all’uso (vedi parte III);

Parametri di addestramento (vedi parte IV);

Elenco parole di attivazione (vedi appendice A)

II Introduzione al modello

Anime Illust Diffusion XL, o AIDXL, è un modello specializzato per generare illustrazioni in stile anime. Ha incorporato più di 800 stili di illustrazione (in continuo aumento con gli aggiornamenti), attivati da parole specifiche (vedi appendice A).

Vantaggi: composizione audace, senza sensazione di posa artificiale, soggetto chiaro, senza dettagli eccessivamente complessi, conosce molti personaggi anime (attivati grazie alla pronuncia giapponese del nome del personaggio, ad esempio "ayanami rei" corrisponde a "绫波丽", "kamado nezuko" a "祢豆子").

III Guida all’uso (aggiornamento costante)

1 Uso base

1.1 Scrittura del prompt

Usare parole di attivazione: usa le parole fornite nell’appendice A per stilizzare l’immagine. Parole appropriate migliorano notevolmente la qualità;

Taggare il prompt: usa tag per descrivere il soggetto da generare;

Ordinare il prompt: ordinare le parole del prompt aiuta il modello a comprenderne il significato. Ordine consigliato:

Parola di attivazione (by xxx)->soggetto principale (1girl)->personaggio (frieren)->razza (elf)->composizione (cowboy shot)->stile (impasto)->tema (fantasy)->ambiente principale (forest, day)->sfondo (gradient background)->azione (sitting)->espressione (expressionless)->caratteristiche principali (white hair)->caratteristiche corpo (twintails, green eyes, parted lip)->abbigliamento (white dress)->accessori abbigliamento (frills)->altri oggetti (magic wand)->ambiente secondario (grass, sunshine)->estetica (beautiful color, detailed, aesthetic)->qualità (best quality)

Prompt negativi: worst quality, low quality, lowres, messy, astratto, brutto, deturpato, anatomia errata, mani deformate, dita fuse, firma, testo, viste multiple

1.2 Parametri di generazione

Risoluzione: assicurarsi che la risoluzione totale (altezza x larghezza) sia intorno a 1024*1024 e che larghezza e altezza siano multipli di 32. Ad esempio, 832x1216 (3:2), 1216x832 (3:2), 1024x1024 (1:1).

Non usare “Clip Skip”, ovvero Clip Skip = 1.

Campionatore e numero di passi: usa il campionatore “euler_ancester”, chiamato Euler A nel webui, con 28 passi a scala CFG di 7.

Usa solo il modello base, senza refiner (modello di raffinamento).

Usa il vae base oppure sdxl-vae.

2 Uso speciale

2.1 Stilizzazione generale

La versione 0.7 riassume diversi stili simili e introduce parole di attivazione stili generalizzati, che rappresentano categorie comuni di stili di illustrazione anime.

Attenzione: queste parole di attivazione non seguono necessariamente il significato artistico originale ma sono ridefinite.

2.2 Personaggi

La versione 0.7 ha migliorato l’addestramento sui personaggi. Alcune parole di attivazione hanno effetto simile a Lora e separano bene il concetto del personaggio dal suo abbigliamento.

Il metodo di attivazione è nome_personaggio \(opera\). Ad esempio, per attivare Lucy nell’animazione "Cyberpunk: Edgerunners" usare lucy \(cyberpunk\); per Gan Yu nel gioco "Genshin Impact", usare ganyu \(genshin impact\). Le parentesi sono sfuggite con \ per evitarne la lettura come ponderazioni. Per alcuni personaggi il copyright è opzionale.

Per la lista delle parole di attivazione si consulta selected_tags.csv · SmilingWolf/wd-v1-4-convnext-tagger-v2 at main (huggingface.co).

Se non basta una parola per personaggio, si aggiungono caratteristiche principali al prompt.

Le parole per personaggio di solito non includono l’abbigliamento; per aggiungerlo, inserire tag vestiti nel prompt, ad es. silver evening gown, plunging neckline per St. Louis nel gioco Azur Lane. Puoi aggiungere tag vestiti di un personaggio a quelli di un altro.

2.3 Tag di qualità

Dalla versione 0.7 i tag di qualità ed estetica sono ufficialmente addestrati. Inserendoli nel prompt influenzano la qualità dell’immagine generata.

I livelli di qualità sono sei: amazing quality, best quality, high quality, normal quality, low quality e worst quality.

Si consiglia di aggiungere peso extra, ad es. (amazing quality:1.5).

2.4 Tag estetici

Dalla versione 0.7 sono stati introdotti tag estetici per descrivere caratteristiche estetiche speciali delle immagini.

2.5 Fusione degli stili

È possibile unire diversi stili nel proprio stile personalizzato. “Fondere” significa usare più parole di attivazione stilistiche simultaneamente. Ad esempio, chun-li, amazing quality, (by yoneyama mai:0.9), (by chi4:0.8), by ask, by modare, (by ikky:0.9).

Consigli:

Controlla peso e ordine degli stili per regolare il risultato.

Aggiungi i tag a fine prompt, non all’inizio.

3 Avvertenze

Usa modelli VAE, embeddings testuali e Lora supportati da SDXL. Nota: sd-vae-ft-mse-original non è un VAE supportato da SDXL; EasyNegative, badhandv4 e altri embeddings negativi non sono embedding supportati da SDXL;

Per versioni 0.61 e precedenti: si raccomanda fortemente di usare embeddings negativi specializzati per il modello (scaricabili nella sezione Suggested Resources), poiché sono fatti appositamente per il modello e hanno quasi solo effetti positivi;

Ogni nuova versione introduce parole di attivazione che potrebbero essere deboli o instabili nella versione corrente.

IV Parametri di addestramento

Basato su SDXL1.0, usando circa 20.000 immagini annotate in circa 100 epoche con tasso di apprendimento 5e-6 e un ciclo nel pianificatore coseno, si ottiene modello A. Poi, con tasso di apprendimento 2e-7 e parametri simili si ottiene modello B. Fondendo A e B si ottiene AIDXLv0.1.

Altri parametri si vedano nella parte in inglese.

V Ringraziamenti speciali

Sponsorizzazione potenza di calcolo: grazie alla community @NieTa (捏Ta (nieta.art)) per il supporto;

Supporto dati: grazie a @秋麒麟热茶 (Profilo KirinTea_Aki | Civitai) e @风吟 (Profilo Chenkin | Civitai) per il gran supporto dati;

Non ci sarebbe stata la versione 0.7 senza di loro.

VI Registro aggiornamenti

2023/08/08: AIDXL è addestrato sullo stesso dataset di AIDv2.10 ma supera quest’ultimo. AIDXL è più intelligente, capace di molte cose che SD1.5 non può. Distingue meglio i concetti, apprende dettagli, gestisce composizioni difficili o impossibili per SD1.5 e AID. In generale, ha un potenziale superiore a SD1.5. Continuerò ad aggiornare AIDXL.

2024/01/27: La versione 0.7 aggiunge molto contenuto, con dimensione del dataset più che raddoppiata rispetto alla versione precedente.

Per ottenere annotazioni soddisfacenti, ho provato molte nuove tecniche di gestione dei tag, come ordinamento, stratificazione casuale, separazione caratteristiche dei personaggi ecc. Progetto su: Eugeoter/sd-dataset-manager (github.com);

Per controllare l’addestramento secondo i miei desideri, ho creato uno script personalizzato basato su Kohya-ss;

Per gestire la fusione dei diversi modelli generativi, ho sviluppato algoritmi euristici e ho evitato di fondere l’encoder testuale e lo strato OUT di UNET per preservare lo stile e stabilità;

Per selezionare e filtrare dati ho addestrato modelli per rilevare watermark, classificazione immagini e valutazione estetica.

VII Sosteneteci

Se ti piace il nostro lavoro, sostienici tramite Ko-fi(https://ko-fi.com/eugeai) per supportare ricerca e sviluppo. Grazie!

Appendice / 附录

A. Elenco parole di attivazione speciali / 特殊触发词列表

Parole di attivazione stile artistico: Cliccami

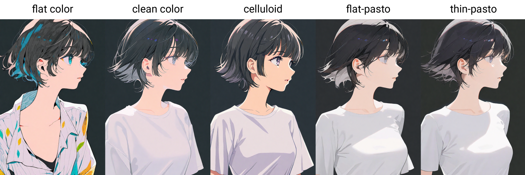

Parole di attivazione stile pittorico: flat color, clean color, celluloid, flat-pasto, thin-pasto, pseudo-impasto, impasto, realistic, photorealistic, cel shading, 3d

flat color: Colori piatti, uso di linee per descrivere luci e ombre

平涂:Colori uniformi, uso di linee e blocchi per luci e ombre

clean color: Stile tra flat color e flat-pasto, colorazione semplice e ordinata.

Colore pulito: stile tra flat color e flat-pasto, semplice e ordinato

celluloid: Colorazione anime

Colorazione celluloide: colorazione anime

flat-pasto: Colore quasi piatto, uso di gradienti per descrivere luci e ombre

Flat-pasto: colore quasi uniforme, usa gradiente per luci e ombre

thin-pasto: Contorni sottili, uso di gradienti e spessore della vernice per luci, ombre e strati

Thin-pasto: contorni sottili, usa gradienti e spessore pittorico per luci e ombre

pseudo-impasto: Uso di gradienti e spessore della vernice per luci, ombre e strati

Pseudo-impasto / semi-impasto: usa gradienti e spessori per luci e ombre

impasto: Uso dello spessore della vernice per descrivere luci, ombre e gradazioni

Impasto: usa lo spessore per luci e ombre

realistic

Realistico

photorealistic: Ridefinito come stile più vicino al mondo reale

Foto-realismo: ridefinito come stile vicino al reale

cel shading: Stile di modellazione 3D anime

Cel shading: stile modellazione 3D anime

3d

Parole di attivazione estetiche:

beautiful

Bello

aesthetic: senso artistico leggermente astratto

Estetico: senso artistico leggermente astratto

detailed

Dettagliato

beautiful color: uso sottile del colore

Colorazione armoniosa: uso sottile del colore

lowres

messy: composizione o dettagli disordinati

Disordinato: composizione o dettagli caotici

Parole di attivazione qualità: amazing quality, best quality, high quality, low quality, worst quality

Dettagli del Modello

Tipo di modello

Modello base

Versione del modello

Hash del modello

Parole addestrate

Creatore

Discussione

Per favore log in per lasciare un commento.