SDXL - Effetto Lenticolare (Più o meno) - v1.0

Prompt Negativi Consigliati

SDXL_TI_my_eyes_are_bleeding_2.0

Parametri Consigliati

samplers

steps

cfg

resolution

other models

Suggerimenti

Aggiungi 'lentclr_effect' all'inizio del prompt per ripristinare lo stile lenticolare se viene perso.

Un numero inferiore di passaggi (500-1000) fonde meglio due immagini, ma è efficace principalmente sui modelli Base XL.

Mixa varie LoRA e modelli per sperimentare e trovare i risultati artistici ideali.

V1.0

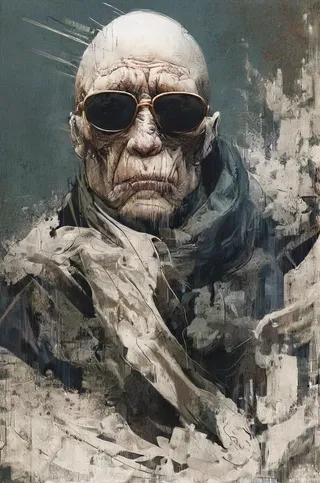

Effetto lenticolare (non l'originale, solo basato sull'idea)

È fondamentalmente solo 2 o più immagini sovrapposte, per lo più con contenuti diversi, che cambiano a seconda dell'angolo di visualizzazione. Inclinando completamente da una parte si vede l'immagine 1, dall'altra l'immagine 2. Google probabilmente può spiegare meglio e più in profondità se interessati. Non sapevo nemmeno che avesse un nome specifico, per me è sempre stato un ologramma.

Questo è praticamente quello che succede quando ti prende un'ondata di nostalgia o ricordi qualcosa e provi a creare una LoRA da quello solo per vedere cosa succede, sapendo che non può funzionare perché diversi fattori non sono corretti o mancano... in questo caso principalmente preparare un dataset in Photoshop che sia almeno coerente nel modo in cui è fatto e la mancanza di movimento.

Non avevo davvero intenzione di rilasciarla, stavo solo scherzando qua e là perché per me ha solo un uso, più o meno, specialmente per scopi di test.

Puntavo alla parte centrale, dove entrambe le immagini si fondono tra loro, insieme all'effetto laminato su plastica o qualcosa del genere. Ovviamente, senza movimento non ha senso puntare all'effetto reale e ci sono altri modi più semplici per farlo. È solo una fusione da un'immagine all'altra. Ma c'è sempre qualcosa che cattura la mia attenzione. Con ogni immagine che ho pubblicato finora su Civit, potrei probabilmente spiegare perché l'ho scelta. Per la maggior parte, non mi interessa la qualità, quanto qualcosa sia alla moda o elegante. Posizioni strane o espressioni, umore, atmosfera, illuminazione, inaspettato, composizione, cose stupide o a volte solo fissarsi su un tema per vedere dove va sono molto probabilmente il mio focus principale, direi. Ho passato abbastanza tempo a studiare arte, anatomia, forme, gesti e tutte le cose noiose associate per sapere se qualcosa non sembra giusto o è fuori posto e, accidenti, molto non va in molte mie immagini... L'AI deve combinare guai per interessarmi. Non significa che non apprezzi un'immagine bella, soprattutto se fatta da qualcun altro, ma l'arte in qualsiasi forma è comunque la cosa più soggettiva, il che aggiunge diversità di per sé.

Beh...

Mi piaceva l'effetto (profondità, un po' dettagliato, incompleto, tratti da schizzo, pittorico)

Produce caos e casualità a una forza maggiore che a volte è difficile da prevedere (a meno che il prompt non lo sovrasti), il che per me è un grande plus, ma serve aggiungere più immagini. Purtroppo ci vuole un bel po' di tempo per scegliere e preparare il dataset, perché anche immagini caotiche non taggate saranno prese dall'addestramento e c'è un bias che voglio evitare/eliminare. Qualità e diversità dovrebbero essere considerate anche secondo me, anche se difficile da valutare dopo la magia di Photoshop. C'è chiaramente un bias verso alcune immagini anche se ho evitato di aggiungere troppe cose che tendo a richiedere nei prompt. La maggior parte delle immagini sono di umani in posizioni artistiche o paesaggi, alcune creature e animali ecc. Ho sempre cercato di combinare 2 immagini con temi e stili artistici diversi, ma alcune erano chiaramente più distinguibili/visibili di altre, quindi tende a preferire quelle immagini.

Base SDXL detesta questa cosa con passione a livelli di forza più alti. Un modello ben addestrato o unito probabilmente è migliore se vuoi creare qualcosa di più, diciamo, "gradevole alla vista". Alcuni modelli praticamente annullano molto l'effetto e se lo vuoi recuperare, aggiungere lentclr_effect all'inizio del prompt dovrebbe aiutare.

Sto testando e passando attraverso i modelli sporadicamente per vedere cosa succede. Per motivi di dimostrazione ho usato solo Base XL (a volte in combinazione con il mio embedding, per eliminare troppo disordine). Ero anche un po' pigro e ho riutilizzato alcuni prompt più vecchi, principalmente per vedere cosa succede e così le altre persone sanno cosa sta succedendo. Durante l'addestramento ho notato che le versioni con un numero inferiore di passaggi (da 500 a 1000) erano effettivamente più vicine all'effetto dove 2 immagini si fondono insieme, ma questo ha avuto impatto solo su modelli più simili a Base XL e tutti gli altri modelli che sono uniti o addestrati ignorano praticamente la LoRA a basso numero di passaggi, quindi si usano 3000 passi. Ho già pubblicato altre immagini tempo fa nella mia galleria fatte con una versione più vecchia e modelli diversi.

Come sempre, mixare LoRA/Modelli fino a quando io o qualcun altro trova il sacro graal, che è da qualche parte... sepolto... molto in profondità... su Marte... sotto una montagna.

Fine della lunga spiegazione che non aiuta affatto.

Dettagli del Modello

Tipo di modello

Modello base

Versione del modello

Hash del modello

Creatore

Discussione

Per favore log in per lasciare un commento.