Jib Mix Flux - fp8 V4 캔버스 갈로어

추천 매개변수

samplers

steps

cfg

resolution

팁

최고의 결과를 위해 Guidance scale을 2에서 3.5 사이로 사용하세요.

낮은 스텝 수(~8)를 사용하면 손 왜곡이 발생할 수 있으니 스텝 수를 늘리거나 낮은 가중치(< 0.10) Hyper Flux Lora를 적용하여 손 디테일을 개선하세요.

NSFW 콘텐츠는 별도의 NSFW Lora 모델과 Nunchaku Lora 로더를 사용해 양자화로 손실된 기능을 복원하세요.

해상도를 200만 픽셀(예: 1024x2048) 이하로 유지하여 ComfyUI 크래시를 방지하세요; 개발자들이 곧 수정할 예정입니다.

설치 시 Nunchaku 및 네이티브 Lora와 ControlNet 지원을 위한 특정 ComfyUI 커스텀 노드를 설치해야 합니다.

호환되는 Nvidia GPU(2000 시리즈 이상)에서 더 빠른 생성을 위해 SVDQuant-4bit 포맷을 사용하세요.

버전 하이라이트

더 좋은 디테일과 훨씬 개선된 아트 스타일을 혼합한 Jib Mix Flux 버전을 병합했고, NSFW 기능도 향상시켰습니다.

크리에이터 스폰서

Jibs Flux NSFW Lora 모델로 강화된 NSFW 이미지 품질을 확인하세요.

완전한 모델 기능을 위해 Nunchaku 프로젝트와 Nunchaku ComfyUI 커스텀 노드를 설치하세요.

이 모델에서 사용되는 워크플로우는 여기에서 다운로드하세요.

저는 SDXL 데이터셋에서 Flux Dev를 학습시키고 로라를 병합하여 해부학 검열과 과도한 보케/블러린 배경을 수정했습니다.

V12 - SRPO 모델과 몇몇 로라를 병합하여 이전 모델보다 좀 더 깔끔한 외관이며, 아마추어 느낌을 원하면 그레인 로라를 추가하는 것을 추천합니다.

저는 NSFW에는 조금 덜 강력하다고 생각해서 아래 제 로라를 사용하시길 권합니다: https://civitai.com/models/652791/jibs-flux-nipple-fix

Jib Mix Flux v8-Flash! SVDQuant-4bit

2025/06/04 업데이트 - 이제 CONTROLNET과 네이티브 LORA 지원 포함!

이 새로운 SVDQuant 포맷은 현재 ComfyUI와 Nvidia 2000 시리즈 이상 GPU가 필요합니다.

추천 설정;

Guidance scale = 2.5-3.5

Sampler = dpmpp_2m.

Scheduler = Sgm_uniform, Beta 또는 Custom Stigmas.

이 모델은 처음 세팅이 다소 까다로우나, flux 이미지 생성을 매우 빠르게 할 수 있어(3090에서 5초, 4090에서 2.5초, 5090에서 0.8초, 10 스텝 기준) 가치가 있습니다.

nunchaku 프로젝트를 해당 지침에 따라 설치해야 합니다.

그리고 nunchaku ComfyUI 커스텀 노드도 설치해 작동시켜야 합니다.

Civitai에서 받은 압축 파일을 \comfyui.git\app\models\diffusion_models\jib-mix-svdq\ 경로에 압축 해제 하세요.

제가 사용하는 Nunchaku 워크플로우는 여기서 확인 가능합니다: https://civitai.com/models/617562

6시간 넘게 걸리는 양자화를 진행해 주신 theunlikely께 감사드립니다!

유감스럽게도 양자화로 인해 NSFW 기능이 감소했으나, 제 NSFW Lora를 사용하면 복원할 수 있습니다. Nunchaku lora 로더를 노드 팩에서 사용하시면 첫 실행 시 자동 변환(및 선택적으로 저장)이 됩니다.

현재 ComfyUI에서 2백만 픽셀 이상(예: 1024x2048) 해상도에서 크래시가 발생하는 제한이 있으니, 발생 시 해상도 또는 업스케일 해상도를 낮추세요. 개발자들은 이번 주 내로 수정 예정입니다.

Jib Mix Flux Version 8 AccentuEight

Jib Mix Flux V7보다 피부 질감이 훨씬 좋아졌으며 Jib Mix V6의 좋지 않은 Flux선이 없습니다.

NSFW 해부학은 약간 부족하므로 별도의 NSFW 모델이나 약간 감소된 디테일/아트스타일, 로라를 사용할 수 있습니다.

V8 Pruned Model nf4 (6.33 GB) 모델은 실제로 Q4_0.gguf

V8 Pruned Model bf16 (11.84 GB) 모델은 실제로 Q8_0.gguf

2025/04/15 - V8의 새로운 fp16 버전은 약간 더 나은 디테일과 해부학 및 이미지 일관성을 제공합니다, VRAM이 충분하다면...

Jib Mix Flux Version 8 AccentuEight NSFW

피부 디테일이 약간 손실된 더 나은 여성 해부학.

V8 NSFW Pruned Model nf4 (6.33 GB) 모델은 실제로 Q4_0.gguf

Jib Mix Flux Version 7.8 Clear Text Focus

이 버전은 더 읽기 쉬운 텍스트 생성에 초점을 맞췄습니다.

피부 질감은 일반적으로 Jib Mix v6 또는 v7만큼 실사적이지 않을 수 있습니다.

옷을 통해 비치는 젖꼭지가 적습니다.

2000s Analog Core @0.6 가중치로, 텍스트에 해를 끼치지 않고 이 병합에서 일부 플라스틱 같은 플럭스 효과를 제거합니다.

Jib Mix Flux Version 7.2 Pixel Heaven

7/7.2 주로 일부 영향받은 로라 병합으로 인해 생긴 "Flux Line" 문제를 수정했습니다. 이로 인해 실사감은 약간 감소했으나 그린/컨셉 능력과 전반적 디테일은 향상되었습니다.

특히 붉은 주근깨 등 지나친 주근깨 양도 줄였습니다.

V7.2 Pruned Model nf4 (6.33 GB) 모델은 실제로 Q4_0.gguf

V7.2 Pruned Model bf16 (11.84 GB) 모델은 실제로 Q8_0.gguf

Jib Mix Flux version 7 PixelHeaven - 베타

주요 변경점은 V6 및 원래 Flux Dev에서 어느 정도 문제였던 "Flux lines"를 제거한 것입니다.

주근깨 양이 과할 수 있으나 사용자 반응을 보고 싶어 베타로 명명했습니다.

Movie Portrait 로라를 비교적 높은 가중치로 사용해 플라스틱 느낌을 줄이는 걸 강력 추천하지만, 실험 중 "Flux Lines" 문제를 일으켜 모델에 병합하지는 않았습니다.

Jib Mix Flux Version 6.1 Real Pix Fixed

6.1 주로 짧고 뭉툭한 손이나 크게 왜곡된 손/팔 문제를 수정하려 했습니다.

(만약 손 문제가 계속되고 스텝을 8 정도 낮게 사용한다면 스텝을 늘리거나 Hyper Flux 로라를 낮은 가중치(< 0.10)로 적용하면 거의 손 문제가 해결되긴 하지만, 디테일이 낮아질 수 있습니다).

V6.1 은 CFG에서 더 현실적이고 자연스러운 얼굴을 제공합니다.

원본 v6보다 아트/만화 스타일에도 더 적합하다고 생각합니다.

V6.1 Pruned Model nf4 (6.33 GB) 모델은 실제로 Q4_0.gguf

V6.1 Pruned Model bf16 (11.84 GB) 모델은 실제로 Q8_0.gguf

테스트에서 V6가 여전히 가장 상세한 배경을 보여줍니다.

V6 Pruned Model nf4 (11.84 GB) 모델은 실제로 Q8_0.gguf

V6 Pruned Model bf16 (6.33 GB) 모델은 실제로 Q4_0.gguf

Jib Mix Flux Version 5 - It's Alive:

실사감 향상 (페인팅 스타일로의 기본 전환 감소)

틀어진 텍스트 문제 수정

더 세밀한 배경

NSFW 약간 재구성

fp8 V4 캔버스 갈로어:

더 나은 세밀한 디테일과 훨씬 개선된 아트 스타일, NSFW 기능 강화.

fp8 V3.0 V3.1 - 클라리티 키

2024/10/21에 잘못된 모델 파일을 업로드했으나, 2024/10/22부터 새로운 파일은 대비가 약간 개선되었고 샘플 이미지에 사용되었습니다.

이 버전은 디테일 수준을 개선하고 원래 flux dev처럼 영화 같은 느낌을 제공합니다.

"Flux Chin" 감소

설정 - Flux Guidance 2.9 사용

Sampler = dpmpp_2m.

Scheduler = Beta 또는 Custom Stigmas.

FP8 V2 - Electric Boogaloo: 더 나은 NSFW 및 피부/이미지 품질.

설정:

최적 설정은 Guidance 2.5, CFG 2.8 (CFG는 생성 속도 저하)

로라 사용 시 값 변동 가능

버전: mx5 GGUF 7GB v1

저사양 그래픽카드용 양자화된 Flux 모델 버전

양자화를 해 주신 https://civitai.com/user/chrisgoringe243께 감사드립니다. 작은 모델 치고 품질이 아주 좋습니다.

중급 그래픽카드용 더 큰 GGUF 버전은 여기에 있습니다: https://huggingface.co/ChrisGoringe/MixedQuantFlux/tree/main

버전 2 - fp16:

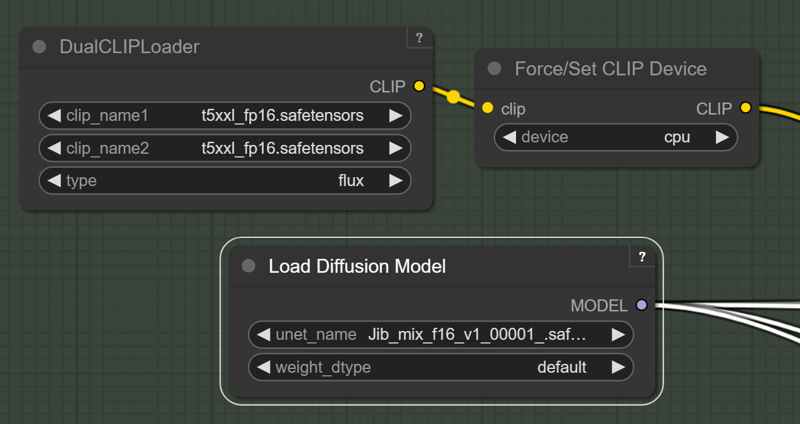

최고 품질을 원하는 고용량 VRAM 카드 사용자를 위해 전체 fp16 Flux 모델과 병합했습니다. "VRAM 24GB만 있는" 경우, 이 팩에 포함된 강제 노드로 T5 텍스트 인코더를 CPU/시스템 RAM으로 강제로 옮겨야 합니다: https://github.com/city96/ComfyUI_ExtraModels

https://github.com/city96/ComfyUI_ExtraModels

작은 양자화 모델을 기다리시는 분들을 위해 여전히 연구 중입니다.

버전 2:

8 스텝 Hyper Lora 및 기타 로라 병합.

설정:

Guidance 2, 8-14 스텝 권장.

해상도: 약 1280x1344 권장

버전 1 : Flux의 막대한 프롬프트 준수 장점과 SDXL의 일부 이점을 결합.

설정:

Guidance 2, 20-40 스텝 권장.