Colossus Project Flux - v10_AIO_FP8

Powiązane słowa kluczowe i tagi

Zalecane podpowiedzi

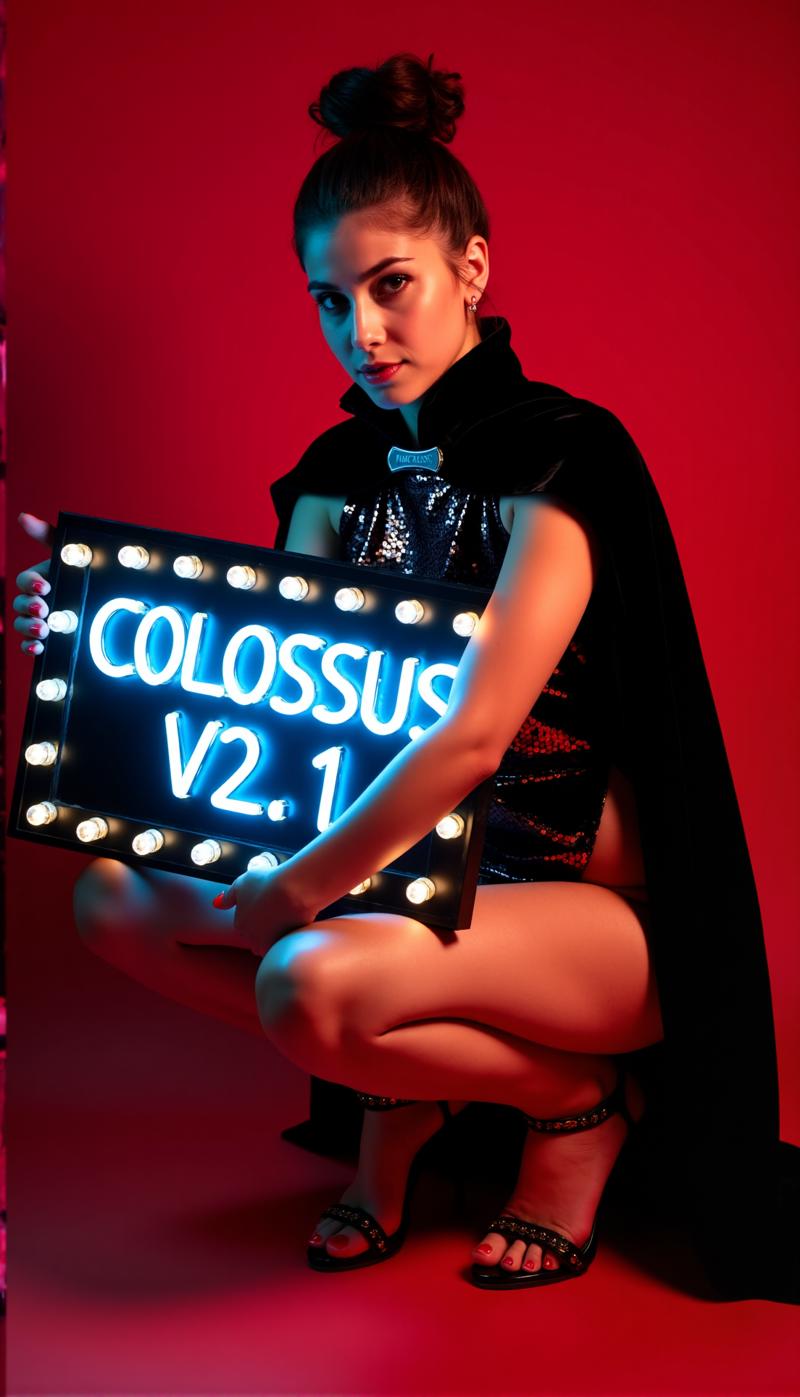

photography of a man wearing a steampunk monocle a swirly fench mustache and a tall top hat, 20-year-old goth woman, he is holding a pocket watch with the manufaturer "COLOSSUS written in black, long white braided hair black ribbon in hair, shot on Panasonic Lumix GH5 with Leica DG 25mm f-1.4, choker necklace, red eyes, slim fit figure, small perk breasts, gothic black leather and lace short lingerie dress, black fishnet thigh high stocking, black lace panties, she is emerging from swirling smoke tendrils, with soft blue ethereal lighting, a very haunting and dark image

Zalecane negatywne podpowiedzi

blurry

blurry, low res

Zalecane parametry

samplers

steps

cfg

resolution

vae

Wskazówki

Używaj negatywnego promptu 'blurry' aby poprawić jakość.

Dla V2.1 wyłącz Flux Guidance scale i używaj zamiast tego cfg.

Zalecenia dotyczące samplerów i schedulerów: Euler z prostym schedulerem działa dobrze; inne samplery jak Heun, DPM++ 2M, Deis i DDIM również działają świetnie.

Wersja V12 'Behemoth' AIO zawiera niestandardowy T5xxl i Clip_L wbudowane w model dla lepszej jakości.

Dostępne są różne wersje kwantyzacji: FP4 tylko dla kart Nvidia 50xx; int4 dla 40xx i niższych (wymagana karta serii minimum 20xx).

Korzystaj z załączonych poradników workflow, aby poprawnie zainstalować i używać modelu.

Najważniejsze informacje o wersji

V10 „Ouroboros”

Sponsorzy twórcy

Jeśli lubisz modele serii FLUX, możesz wesprzeć twórcę na Ko-fi.

Wersje skwantowane i pliki do pobrania dostępne są na Huggingface.

Szczegółowe poradniki instalacji i workflow znajdziesz na Civitai.

Głęboko pod górą śpi olbrzym, zdolny zarówno pomóc ludzkości, jak i sprowadzić zniszczenie...

Powstaje Kolos...

Po serii SDXL czas na serię FLUX tego projektu... Tym razem trenowałem go od podstaw. Do treningu użyłem własnych obrazów. Stworzyłem je moim modelem schnell Flux DemonFlux/Colossus Project schnell oraz jako refiner wykorzystałem mój SDXL Colossus Project 12.

Ten Flux-Checkpoint SD jest w stanie wygenerować niemal wszystko. Colossus doskonale radzi sobie z tworzeniem niezwykle realistycznych zdjęć, anime i sztuki.

Jeśli Ci się podoba, chętnie przyjmę Twoją opinię. Jeśli chcesz mnie wesprzeć, możesz to zrobić tutaj. Wydałem sporo pieniędzy na zbudowanie komputera zdolnego trenować modele Flux. Trening i testowanie zajmują również dużo czasu i prądu.

https://ko-fi.com/afroman4peace

Wersja V12 „Hephaistos”

Publikacja tego checkpointu napełnia mnie zarówno radością, jak i smutkiem. V12 będzie ostatnim checkpointem tej serii. Głównym powodem są nadchodzące przepisy UE dotyczące AI. Kolejnym powodem jest licencja samego Flux .1 DEV. Dziękuję wszystkim za wsparcie! Poświęciłem temu projektowi dużo czasu w ciągu ostatniego roku. Teraz czas przejść do innego projektu.

Tak czy inaczej, kończę tę serię na wysokim poziomie...

V12 opiera się na V10B „BOB”, ale zasadniczo zawiera najlepsze elementy tej serii scalone w jeden checkpoint (efekt nowej metody łączenia, która zajęła około 1:30 h i zużyła cały mój RAM 128 GB). Poprawiłem też tekstury twarzy i skóry w porównaniu do V10. Oczy są dużo bardziej realistyczne i „żywe”.

Przetestuj sam i podziel się opinią o V12. Dzięki mojemu wolnemu łączu internetowemu najpierw wrzucę FP8_UNET, potem wersję FP8 „all in one”, a następnie FP16_unet i FP16_BEHEMOTH. Spróbuję też przekonwertować ją na int4 i fp4 (trzymaj kciuki).

Jak zawsze czekam na feedback dotyczący V12...

Wersja V12 „Behemoth” (AIO)

Ten model „all in one” to najlepszy z mojej serii V12... oraz największy pod względem rozmiaru :-)

Behemoth ma wbudowany niestandardowy T5xxl i Clip_l. Jeśli preferujesz jakość ponad ilość, ten checkpoint jest dla Ciebie!

Wersja V12 FP4/int4

Podziękowania dla Muyang Li z Nunchakutech za kwantyzację V12. https://huggingface.co/nunchaku-tech oraz ich niesamowite nunchaku!

Ta wersja naprawdę zapiera dech w piersiach. Łączy jakość ze szybkością, której wcześniej nie widziano.

UWAGA!

Dostępne są dwie wersje: FP4 i int4. FP4 jest tylko dla kart graficznych Nvidia 50xx! Natomiast int4 działa z 40xx i niższymi (wymagana karta co najmniej serii 20xx).

Obie wersje można pobrać bezpośrednio stąd: https://huggingface.co/nunchaku-tech/nunchaku-flux.1-dev-colossus

PORADNIK INSTALACJI i PRZEBIEG PRACY

Oto szybki poradnik instalacji i wstępny przebieg pracy.

https://civitai.com/articles/17313

https://civitai.com/articles/17358

Wciąż pracuję nad nowymi workflow dla Nunchaku, więc poniższy jest w trakcie tworzenia (WIP). Dodam dokładny artykuł w weekend.

Wersja V12 FP16_B_variant

Dzięki drobnej pomyłce (około 2 rano) nazwałem i wrzuciłem „zły” checkpoint. Jest to wersja bardzo eksperymentalna, nigdy nie miała być publikowana. Nie jest mocno testowana, ale spisała się bardzo dobrze podczas pokazówki. Może być lepsza niż wersja standardowa.

Model preferuje twarze azjatyckie – ponieważ chciałem przetestować coś, co zmiesza się z projektem pobocznym nad którym wciąż pracuję. Podziel się swoimi wrażeniami z tego checkpointu :-)

Wersja V12 AIO FP8

Wersja ta to jednoczesna wersja V12. Wszystkie klipy są w niej wbudowane. Daje takie same rezultaty co FP8_unet z moim niestandardowym clip_l.

Wersja V12 GGUF Q5_1

Ta wersja była na życzenie. Jakość jest niezła.

Wersja V10B „BOB”

Alternatywna wersja V10, stworzona by poprawić FP8. Wersja FP8 jest dokładniejsza, a kolory lepsze. Niestety ostatnio mam mało czasu (życie prywatne najważniejsze), stąd tyle zwłoki. Daj znać jeśli preferujesz tę wersję. Mam też FP16 „BOB”. Po opinii rozważę wydanie wersji int4.

PRZEBIEG PRACY:

Przebieg pracy dla V12 i V10: https://civitai.com/articles/17163

Wersja V10_int4_SVDQ „Nunchaku”

Na początek dziękuję theunlikely https://huggingface.co/theunlikely za konwersję FP16_Unet do int4_SVDQ. Odwiedź jego stronę i zostaw lajka.

Wersja ta jest mniej więcej równa FP8. Nawet w normalnym trybie workflow jest 2-3x szybsza niż standardowy model. W trybie „fast mode” w workflow potrafię wygenerować 2MP obraz w około 19 sekund na mojej 3090ti.

Czym jest SVDQ „Nunchaku”?

Nowa metoda kwantyzacji pozwala zmniejszyć model Flux (tu natywny FP16) z 24GB do około 6,7GB. To nie wszystko: generacje są szybsze niż kiedykolwiek bez dużej utraty jakości. Oczywiście zobaczysz małą różnicę względem mojego 32GB_Behemotha, ale do tego potrzebujesz znacznie więcej VRAM/RAM do uruchomienia.

Więcej informacji: https://github.com/mit-han-lab/ComfyUI-nunchaku?tab=readme-ov-file

Instalacja: Proszę odwiedź mój poradnik instalacji workflow: https://civitai.com/articles/15610

Wersja V10 „Behemoth” (FP16_AIO)

Wciąż eksperymentalna wersja, skupiona na realistycznych efektach. Udało się też zredukować kilka "linii Flux". Bazuje na Colossus Project V5.0_Behemoth, V9.0 oraz innym projekcie zwanym „Ouroborus Project”.

Wersja FP16 jest bardzo stabilna. Wkrótce również wydam wersję FP8. Ta jest dobra, lecz mniej stabilna.

Zachęcam do eksperymentowania. Daj znać jak ci się podoba ta wersja.

Miłej zabawy z tworzeniem :-)

Wersja V9.0:

Muszę dużo wyjaśnić... Dlaczego to w ogóle V9.0?

Niedawno przeprowadziłem się do nowego mieszkania i z powodu błędów dostawcy internetu nie miałem dostępu do internetu. Komputer pracował podczas przeprowadzki, więc powstało wiele (w większości niedziałających) checkpointów. Mam jednak kilka bardzo dobrych wersji V8, które też mogę opublikować.

Co się zmieniło?

Wytrenowałem nowe twarze i tekstury skóry, korzystając z najlepszych wyników V5.0. Dodałem też trening stóp/nóg dla lepszej anatomii. Wersje V5.0 czasem miały błędy przy głowie i stopach; myślę, że udało mi się je naprawić.

Dodatkowo trenowałem na swoich zdjęciach krajobrazów. Tak, robiłem to wszystko podczas przeprowadzki... Całkowity czas treningu wyniósł około 2 tygodni mocy obliczeniowej, co nie jest tanie (godzina pracy kosztuje mnie około 25 centów prądu).

Mam nadzieję, że ta wersja Ci się spodoba. Jeśli chcesz mnie wesprzeć: wrzuć fajne obrazki lub napiwek, np. na Buzz albo Ko-fi.

Podziel się opinią :-)

Wersja 5.0:

V5.0 bazuje na V4.2 i V4.4 (tej ostatniej też wyjdzie niedługo). Dodano dodatkowy trening szczegółów skóry oraz anatomii, co naprawiło rzeczy takie jak dłonie i sutki. Detale twarzy są znacznie lepsze. Próbowałem też naprawić drobne linie Flux.

Ta wersja jest ogólnie bardziej realistyczna niż V4.2 i lepsza w drobnych detalach. Podobnie jak V4.2, jest to model hybrydowy de-distillowany. Można używać podobnych ustawień jak dla V4.2.

Oto nowy Workflow do zabawy: https://civitai.com/articles/11950/workflow-for-colossus-project-flux-50

Podziel się opinią, jak porównujesz ją do 4.2 lub V2.1.

Wersja 4.4 „Research”:

Dodałem tę wersję dla pełności. Jest nieco bardziej realistyczna od V4.2 i stanowi podstawę wersji 5.0. Możesz jej użyć, można też skorzystać z workflow V5.0 i V4.2.

Wersja 4.2:

Jest to dalszy rozwój Demoncore Flux i Colossus Project Flux. Celem było uzyskanie stabilniejszego efektu z lepszymi teksturami skóry, lepszymi dłońmi i większą różnorodnością twarzy. Trenowałem na hybrydowym modelu częściowo Demoncore Flux. Poprawiłem też sutki i NSFW. Daj znać, jeśli wolisz V4.2 od wersji 2.1 :-)

Do pokazówki użyłem tylko obrazów native w rozdzielczości SDXL lub 2MP (np. 1216x1632). Model radzi sobie nawet z większymi rozdzielczościami. Testowałem do 2500x2500, ale rekomenduję około 2000x2000.

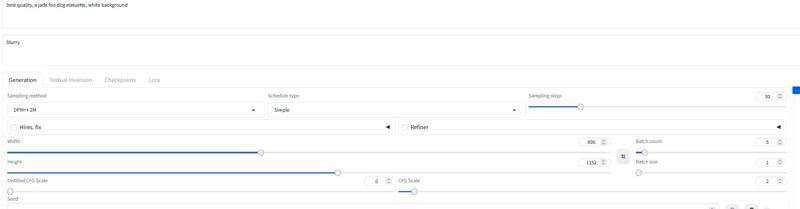

Do ustawień zalecam około 30 kroków i CFG 2-2,5. Najczęściej używam 2,2 lub 2,3 w workflow. Do pokazówki użyłem DPM++ 2M z Simple scheduler.

Niedługo dodam więcej wersji, jednak przed Świętami mam mało czasu.

Ustawienia

Niebawem dodam dedykowany workflow Comfy. Na razie możesz ściągnąć i otworzyć obrazki z pokazówki.

Wersja „All in One” działa też dobrze z Forge.

W zasadzie działa z tymi samymi ustawieniami co wersja 2.1 (patrz niżej).

Ustaw 20-30 kroków i CFG około 2,2.

Wersja 2.1_de-distilled_experimental (MERGE)

Ta wersja jest zupełnie inna i działa inaczej niż normalny model Flux!

Jest to eksperymentalne połączenie mojej wersji 2.0 z de-distilled z https://huggingface.co/nyanko7/flux-dev-de-distill. Stało się to trochę przypadkowo, ale efekty są oszałamiające. Otrzymujesz niesamowite detale, a model doskonale wykonuje prompt. Następne, co zrobię, to trenowanie na modelu de-distilled bezpośrednio. Już robiłem testowe Lory. To bardzo eksperymentalne, więc proszę, raportuj błędy. Ślij też dobre i złe obrazy – to pomaga ulepszać model :-) Możesz też wypróbować wersję 2.0 i powiedzieć, która wersja Ci bardziej odpowiada.

!Uwaga!

Normalny workflow Flux nie działa z tą wersją. MUSISZ pobrać mój workflow!

Możesz się też samemu pokręcić, ale nie obwiniaj mnie za złe obrazy. To bardzo eksperymentalny model... zobacz minusy poniżej.

Zalety i wady tego checkpointu:

Ten checkpoint tworzy ekstremalne detale, ale kosztem szybkości – jest wolniejszy niż normalne checkpointy Flux. Plus jest taki, że zwykle nie potrzebujesz dodatkowego powiększania. Zamiast Flux Guidance model używa skali cfg, co oznacza, że nie działa ze standardowymi workflow.

Możesz stosować negatywne prompty! To pomaga usuwać niepożądane elementy z obrazu.

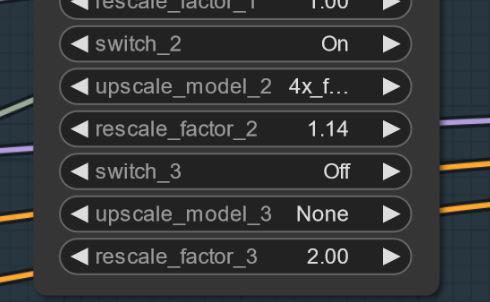

Czasem mogą pojawić się artefakty. Możesz je usunąć prostym powiększeniem (pracuję nad tym). Przykład – nie zdarza się to przy każdym seedzie. AKTUALIZACJA: Nie jest to problem modelu, raczej workflow. Pracuję nad naprawą. Jeśli się pojawia, spróbuj ustawić pierwsze powiększenie na 1.14 zamiast 1.2.

Ustawienia i workflow V2.1:

Workflow znajdziesz tutaj: https://civitai.com/articles/8419

Ustawienia: w przeciwieństwie do normalnego Flux nie potrzebuje Flux Guidance, używaj natomiast cfg. Zwykle stosuję cfg 3. Czasem wymaga niższych wartości.

Najważniejsze: wyłącz Flux Guidance scale.

Bez workflow testowałem go z 30 krokami i cfg 2-3, co może być też ustawieniem dla Forge. Eksperymentuj.

W negatywach polecam używać słowa „blurry”.

Sampler i scheduler:

Dostępnych jest wiele samplerów:

Euler, Heun, DPM++2m, Deis, DDIM działają dobrze.

Najczęściej używałem "simple" jako scheduler.

Jeśli znasz lepsze ustawienia, daj znać :-)

Do Forge polecam wersję AIO – oto przykładowe ustawienie:

Wersja 2.0_dev_experimental

Wersja eksperymentalna mająca na celu stworzenie spójniejszego i szybszego modelu. Wtopiłem dodatkowe własne treningi Lora, a potem połączyłem modele specjalną metodą (Tensor merge). Posiada niestandardowy T5xxl zmodyfikowany przez "Attention Seeker". Dla dodatkowej prędkości i jakości dodałem lora Hyper Flux od ByteDance. Oznacza to przesunięcie pola roboczego. Oto główny obrazek tytułowy.

16 kroków V 2.0

30 kroków V 1.0

30 kroków V 1.0

Wady:

Wady:

Po pierwsze jest nieco większa niż poprzednia wersja. Po drugie, wciąż muszę stworzyć wersję Unet-only. Zaktualizuję, gdy będzie gotowa.

Ustawienia i workflow V2.0:

Model działa teraz z mniejszą liczbą kroków - 16 kroków odpowiada 30 krokom modelu starszego.

Nadal zalecam 20-30 kroków, by uzyskać lepszą jakość.

Sampler: preferuję Euler z "Simple" schedulerem. Można ustawić guidance od 1,5 do 3 (ale testuj poza tym zakresem). Guidance 1,8 działa dobrze dla realistycznych obrazów. Sprawdź też inne samplery: DPM++2M i Heun świetnie działają.

Workflow 2.0:

Stworzyłem nowy workflow dla V2.0 i V1.0, zawierający generator promptów Flux oraz drugi etap upscalingu. https://civitai.com/articles/7946

Forge:

Testowałem model z Forge i działa bardzo dobrze. Obrazy mogą różnić się między Comfy UI a Forge.

Wersja 1.0_dev_beta:

To moja pierwsza wersja serii. Proszę o feedback i zamieszczanie obrazów, co pomoże mi w rozwoju projektu. Do wyboru jest kilka wersji. Najlepsza jakościowo to wersja FP16, ale jest duża i wymaga mocnej karty graficznej oraz dużo RAMu. Wersja FP8 to dobry kompromis między jakością a wydajnością. Jeśli chcesz wersję GGUF, pobierz Q8_0. Wersja GGUF Q4_0/4.1 była na życzenie – są małe, ale tracisz na jakości.

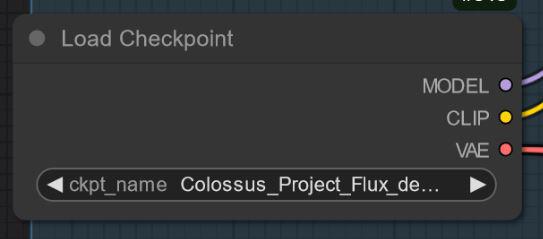

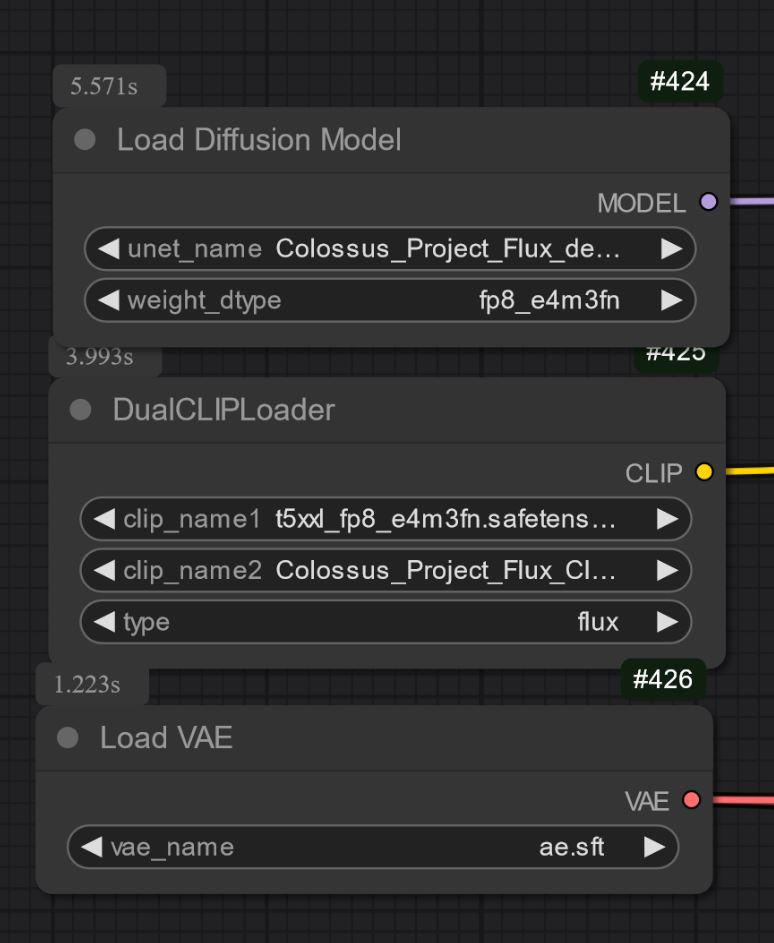

Moje modele są zasadniczo dwóch rodzajów: "All in one", które mają tylko jeden plik do pobrania, z wbudowanymi Clip_l, T5xxl fp8 oraz VAE (patrz niżej). Umieść je w folderze checkpoints.

Druga to wersje UNET-ONLY, gdzie musisz ładować wszystkie pliki osobno.

W każdym przypadku musisz pobrać mój Clip_L, aby działały prawidłowo.

Ważne też, by wybrać odpowiedni klip T5xxl: dla FP8 jest to fp8_e4m3fn t5xxl clip, dla FP16 – clip FP16. Ustaw domyślny typ wag (patrz obrazek dla wersji fp8).

Dla wersji GGUF potrzebujesz loader GGUF!

Znane kwestie dotyczące V1.0:

To dopiero pierwszy model serii, więc może mieć problemy z niektórymi promptami lub stylami (np. sztuka). Następne wersje otrzymają więcej treningu. Powiedz, czego model nie potrafi.

Ustawienia i workflow:

Testowałem z około 30 krokami, Eulerem z prostym schedulerem. Guidance można ustawić w zakresie 1,5-3 (testuj również poza tym zakresem).

Guidance 1,8 sprawdza się dobrze dla realistycznych obrazów.

Śmiało eksperymentuj z ustawieniami. Jeśli masz dobre wyniki, podziel się nimi.

Dodałem obrazki pokazujące dane treningowe. W środku jest workflow do Comfy. Pobierz go tutaj: https://civitai.com/articles/7946

Model „All in one”:

UNET only:

Musisz pobrać również clip_L. To plik 240MB.

Musisz pobrać również clip_L. To plik 240MB.

GGUF: Dodałem workflow dla GGUF tutaj: https://civitai.com/articles/7946

Ważne:

Model deweloperski nie jest przeznaczony do użytku komercyjnego. Wersję "schnell" opublikuję w innym miejscu. Jest bardziej do użytku osobistego lub naukowego.

LICENCJA:

https://huggingface.co/black-forest-labs/FLUX.1-dev/blob/main/LICENSE.md

Podziękowania:

theunlikely https://huggingface.co/theunlikel (dziękuję jeszcze raz)

Wersja 2.1/V4.2/5.0: Flux_dev_de-distill od nyanko7

https://huggingface.co/nyanko7/flux-dev-de-distill

Od V2.0: Hyper Lora od ByteDance https://huggingface.co/ByteDance/Hyper-SD

Black Forrest za ich niesamowity model Flux https://huggingface.co/black-forest-labs

Szczegóły modelu

Typ modelu

Model bazowy

Wersja modelu

Hash modelu

Twórca

Dyskusja

Proszę się log in, aby dodać komentarz.

Kolekcja modeli - Colossus Project Flux

Colossus Project Flux - v12_int4_SVDQ_nunchaku

Colossus Project Flux - V12 "Hephaistos" FP8_UNET

Colossus Project Flux - v10_AIO_FP8