Stabilizer IL/NAI - illus01 v1.185c

Parole Chiave e Tag Correlati

Prompt Consigliati

masterpiece

Parametri Consigliati

samplers

steps

cfg

resolution

other models

Parametri Consigliati per Alta Risoluzione

upscaler

upscale

denoising strength

Suggerimenti

Applica Stabilizer LoRA a modelli base vanilla come NoobAI o RouWei con intensità tra 0.5 e 0.8 per risultati ottimali.

Usa da 1 a 3 tag di stile o LoRA insieme a Stabilizer per mantenere la creatività senza stile predefinito o effetti di overfitting.

Evita modelli base con stile AI predefinito forte, perché possono sopprimere l’effetto di Stabilizer causando spostamenti di stile.

Lascia un feedback dettagliato nella sezione commenti anziché nel sistema recensioni di Civitai per una migliore visibilità.

Usa la versione “c” per immagini colorate e visivamente impattanti, e la versione senza "c" per texture naturali e riproduzione accurata dello stile.

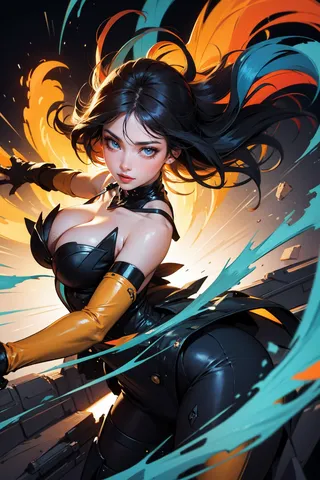

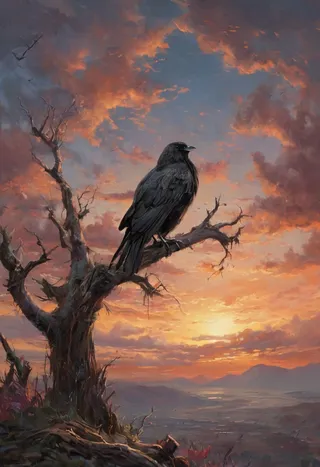

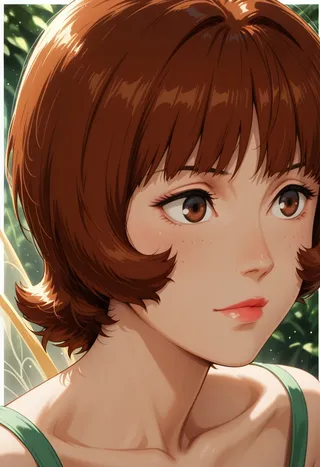

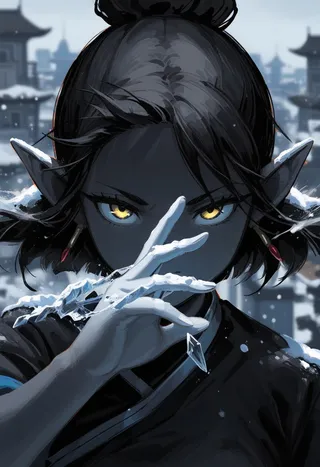

Le immagini di copertina provengono direttamente dal modello base vanilla (l'originale) in a1111, alla risoluzione predefinita di 1MP. Nessun upscaling, nessun plugin. Se pensi che siano immagini ingrandite perché sembrano così nitide, questo LoRA ha fatto bene il suo lavoro.

È vietato condividere merge con questo LoRA o ristamparlo su altre piattaforme. Questo modello è pubblicato solo su Civitai e TensorArt. Se vedi "me" e questa frase su altre piattaforme, sono tutte false e la piattaforma che stai usando è pirata.

Stabilizer

È un LoRA modello base finemente regolato tutto-in-uno senza stile predefinito.

Applicandolo a vanilla NoobAI e-pred v1.1, otterrai un modello base finemente regolato.

Tutto-in-uno: include tutte le migliorie comunemente necessarie. Illuminazione naturale e dettagli, comprensione stabile del prompt, sfondo migliore, mani migliori...

Uguale al modello base finemente regolato originale. Non esiste nessuno stile predefinito. Il dataset è molto diversificato. Il modello base mantiene la sua massima creatività. Non ottieni la ripetizione degli stessi elementi (volti, sfondi, ecc.) continuamente. (A differenza dei modelli base uniti che fondono molti LoRA con stile overfittato)

La maggior parte degli stili incorporati nei modelli base originali sono molto overfittati. Questo LoRA risolve questo problema. Grazie al dataset molto vario, puoi usare migliaia di tag di stile Danbooru incorporati, così come stili generali che SDXL originale comprende, ottenendo un'immagine pulita e dettagliata come dovrebbe essere. Nessun effetto di overfitting. Nessuna immagine deformata. Nessuna contaminazione di stile da modelli uniti. Che sia 2D o 3D, astratto o realistico. Esempio:

Guarda i confronti: 1 (stili artistici), 2 (stili generali)

Il dataset di addestramento contiene solo immagini ad alta risoluzione (media pixel > 3MP, ~1800x1800). Zero immagini AI. Quindi ottieni texture e dettagli reali oltre il livello pixel, invece di bordi finti e superfici lisce senza texture.

Tuttavia, essendo un LoRA, puoi applicarlo a qualsiasi modello base vuoi con intensità regolabile in un secondo.

Perché tutto-in-uno? Perché se addestri 10 LoRA con 10 dataset diversi per aspetti diversi, e li sovrapponi, il modello base impazzirà. Se addestri tutti i dataset insieme, non ci saranno conflitti.

Perché non rifinire l’intero modello base? Non sono un gigachad e non ho milioni di immagini per l’addestramento, quindi rifinire tutto il modello base non è necessario.

Perché raccomandi NoobAI ma hai abbandonato la versione NoobAI di questo LoRA? 1. Con il dataset sempre più grande, addestrare diventa costoso e richiede tempo. 2. Non ho riscontrato peggioramenti usando la versione illus su NoobAI.

È vietato condividere merge con questo LoRA. Ci sono parole trigger nascoste per stampare watermark invisibili. Funziona bene anche con una forza di merge di 0.05. Ho codificato io stesso watermark e rivelatore. Non voglio usarlo, ma posso.

Ricordati di lasciare feedback nella sezione commenti, così tutti possono vederlo. Non scrivere feedback nel sistema di recensioni Civitai, è mal progettato, nessuno trova e vede le recensioni.

Buon divertimento.

Disambiguazione:

"Stabilizer" significa: applicandolo al modello base vanilla, riduce gli effetti di overfitting e aggiunge dettagli. Vedi immagini di copertina.

Non può risolvere magicamente un modello base già rovinato da molti LoRA sovrapposti.

Come usare

Prefisso versione:

illus01 = Addestrato su Illustrious v0.1. (Raccomandato, anche per NoobAI)

nbep11 = Addestrato su NoobAI e-pred v1.1. (Discontinuato)

Versione "c" (dopo illus v1.152):

"c" sta per "colorato", "creativo", a volte "caotico". Questa versione contiene immagini di addestramento molto visivamente impattanti, es.: molto colorate, alto contrasto, forte post-effetto, illuminazione complessa, oggetti e motivi ovunque. Otterrai immagini "visivamente impressionanti", ma meno "naturali". Può influenzare stili con colori morbidi.

Se vuoi qualcosa di bello esteticamente, usa la versione "c".

Se vuoi texture naturali o riprodurre stili accuratamente, usa la versione non "c".

Raccomandato:

Modelli base vanilla (NoobAI, RouWei, ecc.) senza stile predefinito overfittato.

Questo LoRA con forza tra 0.5 e 0.8.

1-3 tag di stile o LoRA.

Non raccomandato:

Modelli base con stile AI predefinito forte.

Oltre il 90% dei modelli base include stili AI. Sono stili puliti e coerenti, facili da addestrare e usare. Stili AI forti sopprimeranno quasi tutti gli effetti di questo LoRA, causando spostamenti di stile. Vedi confronto. Sopra vanilla NoobAI, sotto WAI con stile AI forte.

Come capire se un modello ha stile AI? Nessun metodo perfetto. La maggior parte degli stili AI appare liscia perché mancano texture, con riflessi strani e lucidi dappertutto, quindi sembra plastica.

Versioni vecchie:

Nuova versione == nuove funzionalità e tentativi. Un grande vantaggio del LoRA è poter mescolare diverse versioni facilmente.

Più info nel "log aggiornamenti". Attenzione che versioni vecchie possono avere effetti molto diversi.

Ora ~: punta su dettagli naturali e texture, comprensione stabile del prompt e più creatività.

Illus01 v1.23 / nbep11 0.138 ~: focus su puro stile anime con colori vividi.

Illus01 v1.3 / nbep11 0.58 ~: focus su stile anime.

Dataset

versione più recente o recenti

~7k immagini totali. Tutte selezionate a mano da me.

Solo cose normali e belle. Niente stili artistici folli non descrivibili. Niente immagini AI, nessun watermark, ecc.

Solo immagini ad alta risoluzione. Media pixel dataset 3.37 MP, ~1800x1800.

Tutte le immagini hanno didascalie naturali create dal più recente LLM di Google.

Tutti i personaggi anime sono taggati prima da wd tagger v3 e poi da Google LLM.

Include natura, esterni, interni, animali, oggetti quotidiani, molte cose, esclusi umani reali.

Contiene tutte le condizioni di luminosità: molto scuro, molto chiaro, molto scuro e molto chiaro insieme.

Altri strumenti

Alcune idee che erano o sarebbero state parte di Stabilizer. Ora sono LoRA separati per maggiore flessibilità. Link collezione: https://civitai.com/collections/8274233.

Touching Grass: LoRA addestrato solo su dataset del mondo reale (niente anime). Effetto più forte. Migliore sfondo e illuminazione. Utile per utenti gigachad che amano concetti puri e bilanciare i pesi autonomamente.

Dark: LoRA che corregge bias di alta luminosità in alcuni modelli base. Addestrato con immagini a bassa luminosità nel dataset Touching Grass. Nessun umano nel dataset, quindi stile non influenzato.

Contrast Controller: LoRA artigianale. (Non da addestramento). Il più piccolo LoRA visto, 300KB. Controlla il contrasto come uno slider del monitor. A differenza di altri "enhancer" addestrati, questo effetto è stabile, matematicamente lineare e senza effetti collaterali sullo stile.

Utile se il tuo modello base ha problemi di sovrasaturazione o vuoi qualcosa di molto colorato.

Esempio:

Style Strength Controller: oppure riduttore di effetti overfitting. Anche questo artigianale, non da addestramento, nessun effetto collaterale sullo stile, effetto matematicamente lineare. Riduce tutti i tipi di effetti overfitting (bias su oggetti, luminosità, ecc.).

Test su Hassaku XL: modello base con molti bias, es. luminosità alta, superficie liscia e lucida, scritte sui muri... Il prompt contiene la parola chiave "dark", ma il modello quasi la ignora. A forza 0.25, meno bias di luce alta, meno effetto di lisciatura innaturale, immagine più naturale.

Differenze con Stabilizer:

Differenze con Stabilizer:

Stabilizer è addestrato su dati reali. Può solo "ridurre" effetti di overfitting su texture, dettagli e sfondi, aggiungendoli indietro.

Style Controller non deriva da addestramento. È più una "cancellazione" dell’addestramento del modello base, rendendolo meno overfittato. Riduce matematicamente tutti gli effetti di overfitting, tipo bias su luminosità, oggetti.

Log aggiornamenti

(21/06/2025) illus01 v1.185c:

Rispetto a v1.165c.

+100% nitidezza e definizione. Linee a larghezza di un pixel. Puoi persino percepire la texture di una carta bianca. (Veramente, la carta realistica non è bianca pura, ha rumore). Un'immagine da 1MP ora sembra da 2K.

-30% immagini troppo caotiche (non descrivibili bene). Quindi questa versione potrebbe non offrire più contrasti elevatissimi, ma è più stabile per usi normali.

(10/06/2025): illus01 v1.165c

Versione speciale. Non è un miglioramento di v1.164. "c" significa "colorato", "creativo", a volte "caotico".

Il dataset contiene immagini molto visivamente impattanti, ma a volte difficili da descrivere: molto colorate, alto contrasto, illuminazione complessa, oggetti e motivi complessi ovunque.

Quindi immagini "visivamente impattanti", ma a costo di naturalezza. Può influenzare stili con colori delicati, ecc. Es. questa versione non genera perfettamente la texture "pencil art" come v1.164.

(04/06/2025): illus01 v1.164

Migliore comprensione del prompt. Ora ogni immagine ha 3 didascalie naturali da diversi punti di vista. I tag Danbooru sono controllati da LLM, solo i tag importanti sono estratti e fusi nelle didascalie naturali.

Anti-sovraesposizione. Aggiunto bias per evitare che l’output raggiunga #ffffff bianco puro. Spesso #ffffff = sovraesposizione con perdita di dettagli.

Cambiamenti nelle impostazioni di addestramento per maggiore compatibilità con NoobAI, sia e-pred che v-pred.

(19/05/2025): illus01 v1.152

Miglioramento continuo di illuminazione, texture e dettagli.

5K immagini aggiuntive, più passi di addestramento, effetto più forte.

(09/05/2025): nbep11 v0.205:

Correzione rapida di problemi di luminosità e colore in v0.198. Ora non cambia luminosità e colori in modo troppo drastico come una foto reale. v0.198 non è male, solo troppo creativa.

(07/05/2025): nbep11 v0.198:

Aggiunte più immagini scure. Meno corpi deformati, meno sfondi scuri deformati.

Rimosso miglioramento colore e contrasto. Ora non serve più. Usa Contrast Controller.

(25/04/2025): nbep11 v0.172.

Stesse nuove funzionalità di illus01 v1.93 ~ v1.121. Sintesi: nuovo dataset fotografico "Touching Grass". Texture naturale migliore, sfondo, illuminazione. Effetti personaggi attenuati per migliore compatibilità.

Migliore accuratezza del colore e stabilità. (vs nbep11 v0.160)

(17/04/2025): illus01 v1.121.

Tornato a illustrious v0.1. Le versioni illustrious v1.0 e successive avevano immagini AI deliberate (circa 30% dataset), non ideale per addestramento LoRA. Non me ne ero accorto finché non ho letto il paper.

Effetto stile personaggio ridotto. Torna al livello di v1.23. Personaggi avranno meno dettagli da questo LoRA, ma compatibilità migliore. È un compromesso.

Altre cose come sotto (v1.113).

(10/04/2025): illus11 v1.113 ❌.

Aggiornamento: usa questa versione solo se il tuo modello base è basato su Illustrious v1.1. Altrimenti usa illus01 v1.121.

Addestrato su Illustrious v1.1.

Nuovo dataset "Touching Grass" aggiunto. Texture naturale, illuminazione e effetto profondità campo migliore. Stabilità strutturale sfondo migliorata. Meno sfondi deformati come stanze o edifici disformi.

Didascalie completamente in linguaggio naturale da LLM.

(30/03/2025): illus01 v1.93.

v1.72 era troppo forte. L'ho ridotta complessivamente. Compatibilità migliorata.

(22/03/2025): nbep11 v0.160.

Stesse funzionalità di illus v1.72.

(15/03/2025): illus01 v1.72

Stesso nuovo dataset texture e illuminazione menzionato in ani40z v0.4 sotto. Illuminazione e texture più naturali.

Aggiornato piccolo dataset ~100 immagini per miglioramento mani, con compiti diversi come tenere bicchiere o tazza.

Rimosso tutte le immagini "sfondo semplice" dal dataset. -200 immagini.

Spitato strumento di addestramento da kohya a onetrainer. Cambiata architettura LoRA a DoRA.

(04/03/2025) ani40z v0.4

Addestrato su Animagine XL 4.0 ani40zero.

Aggiunto ~1k dataset concentrato su illuminazione dinamica naturale e texture mondo reale.

Illuminazione e texture più naturali.

ani04 v0.1

Versione iniziale per Animagine XL 4.0. Soprattutto per correggere problemi di luminosità Animagine 4.0. Contrasto migliore e più alto.

illus01 v1.23

nbep11 v0.138

Aggiunte immagini furry/non-umane/altre per bilanciare dataset.

nbep11 v0.129

Versione scadente, effetto troppo debole, ignorala.

nbep11 v0.114

Implementato "Colori a gamma completa". Bilancia automaticamente verso "normale e bello". Più o meno il pulsante "auto enhance" negli editor di foto. Svantaggio: impedisce bias estremi. Es. vuoi che il 95% sia nero e 5% chiaro, non 50/50.

Aggiunti dati più realistici. Dettagli, illuminazione più vividi, colori meno piatti.

illus01 v1.7

nbep11 v0.96

Più immagini per addestramento.

Rifinito nuovamente su piccolo dataset "wallpaper" (wallpaper di gioco reali, qualità migliore trovata, ~100 immagini). Migliore dettaglio (pelle, capelli) e contrasto.

nbep11 v0.58

Più immagini. Parametri di addestramento vicini al modello base NoobAI.

illus01 v1.3

nbep11 v0.30

Più immagini.

nbep11 v0.11: Addestrato su NoobAI epsilon pred v1.1.

Migliorati tag dataset. Migliorata struttura LoRA e distribuzione pesi. Più stabile e meno impatto sulla composizione immagine.

illus01 v1.1

Addestrato su illustriousXL v0.1.

nbep10 v0.10

Addestrato su NoobAI epsilon pred v1.0.

Dettagli del Modello

Tipo di modello

Modello base

Versione del modello

Hash del modello

Creatore

Discussione

Per favore log in per lasciare un commento.

Collezione di Modelli - Stabilizer IL/NAI

Stabilizer IL/NAI - illus01 v1.23

Stabilizer IL/NAI - illus01 v1.121

Stabilizer IL/NAI - illus01 v1.185c

Stabilizer IL/NAI - nbep11 v0.138

Stabilizer IL/NAI - illus01 v1.152

Stabilizer IL/NAI - illus01 v1.165c

Stabilizer IL/NAI - nbep11 v0.205

Stabilizer IL/NAI - illus01 v1.72

Stabilizer IL/NAI - illus01 v1.198

Stabilizer IL/NAI - nbep11 v0.114