Jib Mix Flux - v8.5 - ConsistEight

推薦提示詞

highly detailed, vignette, bokeh, high budget, cinemascope, epic, gorgeous, moody, film grain, grainy

推薦反向提示詞

((cartoon)), ((bokeh)), Deviantart, jpeg, (worst quality, low quality, normal quality, lowres, low details, oversaturated, undersaturated, overexposed, underexposed, grayscale, bw, bad photo, bad photography, bad art:1.4), (watermark, signature, text font, username, error, logo, words, letters, digits, autograph, trademark, name:1.2), (blur, blurry, grainy), morbid, ugly, asymmetrical, mutated malformed, mutilated, poorly lit, bad shadow, draft, cropped, out of frame, cut off, censored, jpeg artifacts, out of focus, glitch, duplicate, (airbrushed, cartoon, anime, semi-realistic, cgi, render, blender, digital art, manga, amateur:1.3), (3D, 3D Game, 3D Game Scene, 3D Character:1.1), (bad hands, bad anatomy, bad body, bad face, bad teeth, bad arms, bad legs, deformities:1.3), ((bokeh)) Deviantart

推薦參數

samplers

steps

cfg

resolution

提示

要運行 SVDQuant 格式,請安裝 Nunchaku 項目及 Nunchaku ComfyUI 自訂節點以確保兼容性。

使用 Nunchaku lora 加載器首次使用時可自動轉換 NSFW LoRA 模型。

若 ComfyUI 在超過 200 萬像素(1024x2048)時崩潰,請降低生成或放大解析度,直到修復版本釋出。

增加步數可改善手部解剖問題;或者應用低權重(<0.10)Hyper Flux lora 亦能修正手部。

使用『Movie Portrait』Lora 並調高權重可減少塑料感,但合併時可能導致 flux 線條。

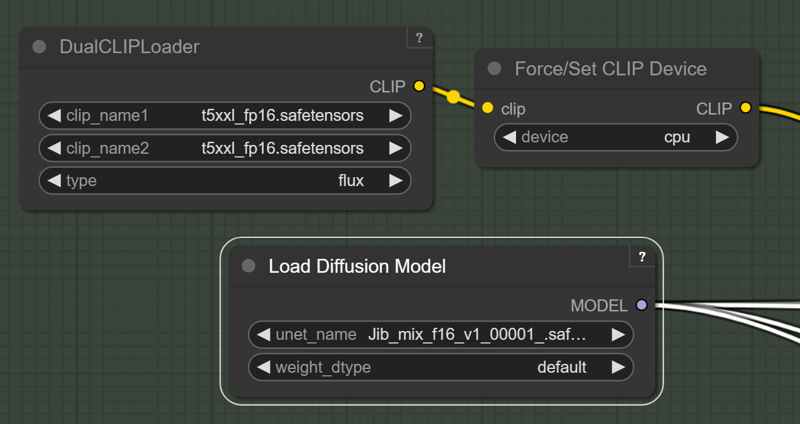

對於高 VRAM 顯卡,fp16 合併版本提供更佳品質,但可能需強制將 T5 編碼器移至 CPU/記憶體。

版本亮點

此版本將超細節藝術風格稍作調整,以提升手部等部位的一致性。

創作者贊助

安裝 nunchaku 項目 和 nunchaku ComfyUI 自訂節點 以使用 SVDQuant-4bit 模型。從 Civitai 下載模型壓縮包到你的 ComfyUI 模型資料夾。

特別感謝 theunlikely 使用 H100 GPU 支援量化工作。

我已在我的 SDXL 數據集中訓練了 Flux Dev 並合併了 lora,修正了解剖學審查和過度的散景/模糊背景問題。

2025年4月15日 - 最新的 V8 fp16 版本在細節、解剖和影像一致性方面略有提升,如果你的 VRAM 足夠......

Jib Mix Flux v8-Flash!SVDQuant-4bit

2025年4月6日更新 - 現已支援 CONTROLNET 和原生 LORA!

此新 SVDQuant 格式目前需要 ComfyUI 和 Nvidia 2000 系列以上 GPU。

建議參數;

指導尺度 = 2.5-3.5

採樣器 = dpmpp_2m。

調度器 = Sgm_uniform、Beta 或自訂 Stigmas。

此模型屬於新的格式,初期設置較為複雜,但值得,因為它能實現超高速的 flux 影像生成(3090 約 5 秒,4090 約 2.5 秒,5090 約 0.8 秒,步數10次),

你需要依照指引安裝 nunchaku 項目。

以及nunchaku ComfyUI 自訂節點來啟用模型。

請從 Civitai 下載並解壓縮模型檔案至:\comfyui.git\app\models\diffusion_models\jib-mix-svdq\

這是我目前使用的 Nunchaku 工作流程:https://civitai.com/models/617562

非常感謝 theunlikely 為量化工作提供 H100 GPU 的支持,耗時約 6 小時!

不幸的是,量化過程中 NSFW 功能有所減弱,但可使用我的 NSFW Lora 恢復。你需要使用 Nunchaku lora 加載器,首次使用時會自動轉換 lora(可選擇保存)。

目前 ComfyUI 在超過 200 萬像素 (1024x2048) 時會崩潰,遇到此情況請降低生成或升頻解析度,開發者表示本週會釋出修復版本。

Jib Mix Flux 版本 8 AccentuEight

皮膚紋理明顯優於 Jib Mix Flux V7,且不帶有 Jib Mix V6 的明顯 Flux 線條。

NSFW 解剖細節略為不足,故上傳了獨立的 NSFW 模型,有稍微降低的細節/藝術風格,或可搭配其他 loras 使用。

V8 剪枝模型 nf4 (6.33 GB) 實際即為 Q4_0.gguf

V8 剪枝模型 bf16 (11.84 GB) 實際即為 Q8_0.gguf

Jib Mix Flux 版本 8 AccentuEight NSFW

女性解剖更佳,但皮膚細節略有犧牲。

V8 NSFW 剪枝模型 nf4 (6.33 GB) 實際為 Q4_0.gguf

Jib Mix Flux 版本 7.8 Clear Text Focus

此版本專注於提升文字的辨識度。

皮膚紋理可能不如 Jib Mix v6 或 v7 那般寫實。

衣物穿透乳頭的情況減少。

2000s Analog Core @0.6 權重,減少合併後的塑膠感 Flux 線條,但不影響文字表現。

Jib Mix Flux 版本 7.2 Pixel Heaven

7/7.2 主要修正合併部分 lora 導致的「Flux 線條」,這導致寫實度略有下降,但繪畫/概念能力和細節提升。

同時減弱了過量的雀斑(尤其是紅色雀斑)。

V7.2 剪枝模型 nf4 (6.33 GB) 實際為 Q4_0.gguf

V7.2 剪枝模型 bf16 (11.84 GB) 實際為 Q8_0.gguf

Jib Mix Flux 版本 7 PixelHeaven - 測試版

主要變更是移除困擾 V6 和原 Flux Dev 的「Flux 線條」。

雀斑可能過多,但我想看看大家對此的感覺,因此稱為 Beta。

我強烈推薦以較高權重使用 Movie Portrait Lora,打造更自然的質感,但無法合併入模型,因它可能引發 Flux 線條。

Jib Mix Flux 版本 6.1 Real Pix Fixed

6.1 主要嘗試修正短小或嚴重畸形的雙手/手臂。

(若使用約 8 步的低步數生成仍有手部問題,建議提升步數;或低權重(<0.10)應用 Hyper Flux lora 通常能修正手部,但可能降低細節)。

V6.1 在 CFG 調整與自然面部表現上更為寫實。

我認為它在藝術/卡通風格表現上也優於原始 V6。

V6.1 剪枝模型 nf4 (6.33 GB) 實際為 Q4_0.gguf

V6.1 剪枝模型 bf16 (11.84 GB) 實際為 Q8_0.gguf

V6 在我測試中仍擁有最細緻的背景。

V6 剪枝模型 nf4 (11.84 GB) 實際為 Q8_0.gguf

V6 剪枝模型 bf16 (6.33 GB) 實際為 Q4_0.gguf

Jib Mix Flux 版本 5 - 它活了起來:

提升寫實照片感。(較少偏向繪畫風格)

修正文字錯亂問題。

背景更為細緻。

輕微調整 NSFW 部分。

fp8 V4 Canvas Galore:

更細膩的細節與優秀的藝術風格,並增強 NSFW 功能。

fp8 V3.0 V3.1 - 清晰鍵

我於 2024 年 10 月 21 日上傳錯誤模型檔案,後於 10 月 22 日更換新文件,細節稍有提升,並用於示範圖像。

此版本提升細節層次,且比原 flux dev 更具電影感。

減少了「Flux 下巴」現象。

設定 - Flux 指導為 2.9

採樣器 = dpmpp_2m。

調度器 = Beta 或自訂 Stigmas。

FP8 V2 - Electric Boogaloo: 更佳的 NSFW 和皮膚/影像品質。

設定:

我發現最佳參數為指導 2.5 和 CFG 2.8(雖然 CFG 會稍減慢生成速度)。

使用 Loras 時參數可能會變動。

版本:mx5 GGUF 7GB v1

此為我 Flux 模型的量化版本,適用於較低端顯卡。

感謝 @https://civitai.com/user/chrisgoringe243 進行量化,對於如此小的模型來說品質非常好。

此處提供較大尺寸的 GGUF 版本:https://huggingface.co/ChrisGoringe/MixedQuantFlux/tree/main

適用中階顯卡。

版本 2 - fp16:

針對高 VRAM 顯卡,提供最高品質,為完整 fp16 Flux 模型合併。

若你「只有 24GB VRAM」,需要透過此套件中的強制節點將 T5 文本編碼器移至 CPU/系統記憶體: https://github.com/city96/ComfyUI_ExtraModels

https://github.com/city96/ComfyUI_ExtraModels

仍在尋找更小型的量化模型版本。

版本 2:

合併了 8 步 Hyper Lora 及其他模型。

設定:

我喜歡指導為 2,步數 8-14。

解析度:我偏好約 1280x1344。

版本 1:結合了 SDXL 的部分優勢及 Flux 的巨大提示遵從利益。

設定:

我喜歡指導 2,步數 20-40。